189 KiB

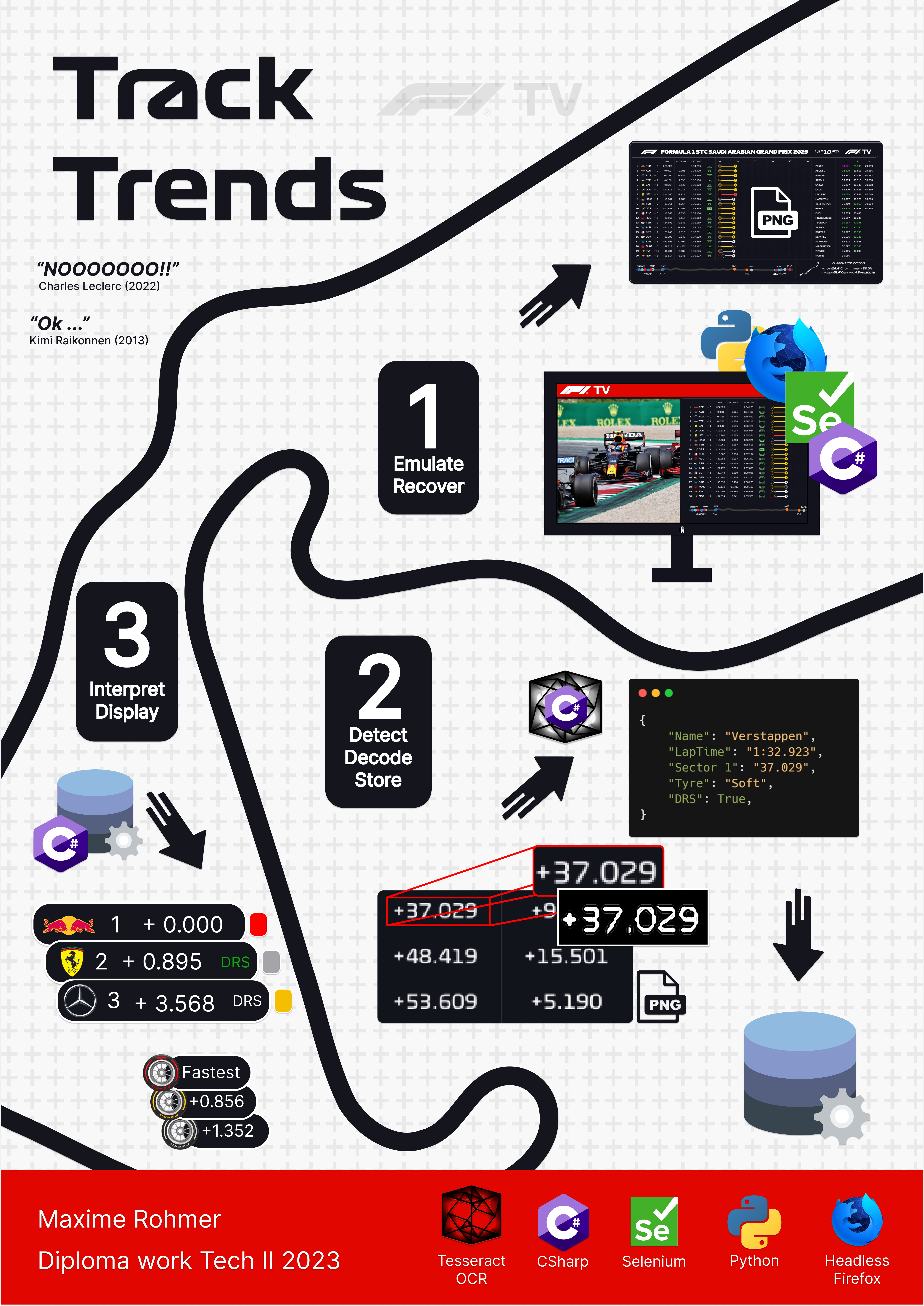

Rapport Track Trends V1.0

Rohmer Maxime Travail de diplôme Technicien ES 2023

Introduction

Résumé

Track Trends est un outil de récupération et d'analyse de données de courses de Formule 1.

Pour le contexte, en dehors des cours, j'exerce différentes activités dont celle de Live Ticker F1 pour le 20 minutes. Pour m'aider dans ce travail, j'utilise actuellement la F1TV à laquelle je suis abonné qui me propose non seulement un feed vidéo de meilleure qualité avec des commentaires plus pertinents que ceux de la RTS mais qui aussi me permet d'accéder à un feed vidéo très important : la chaine data.

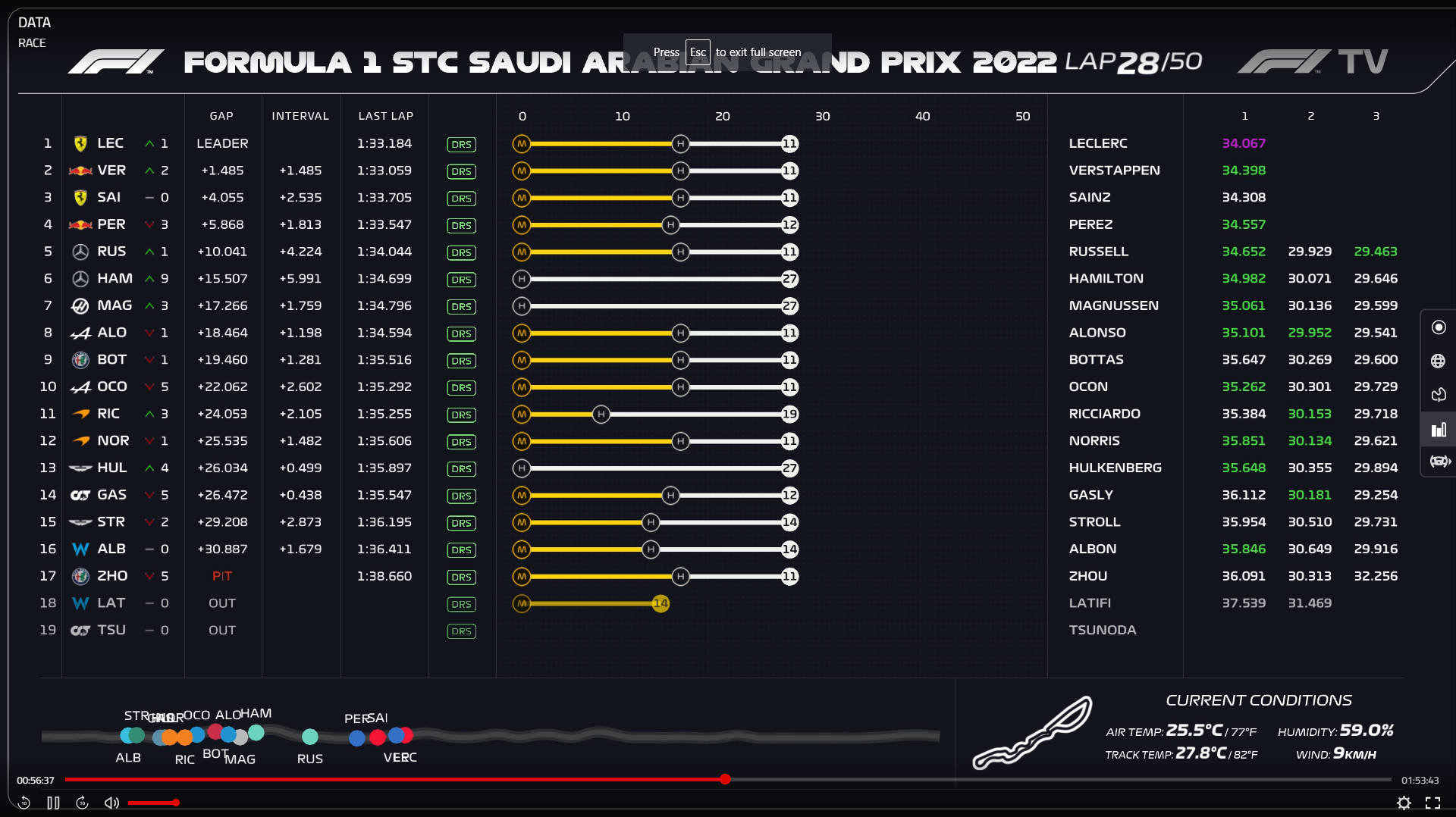

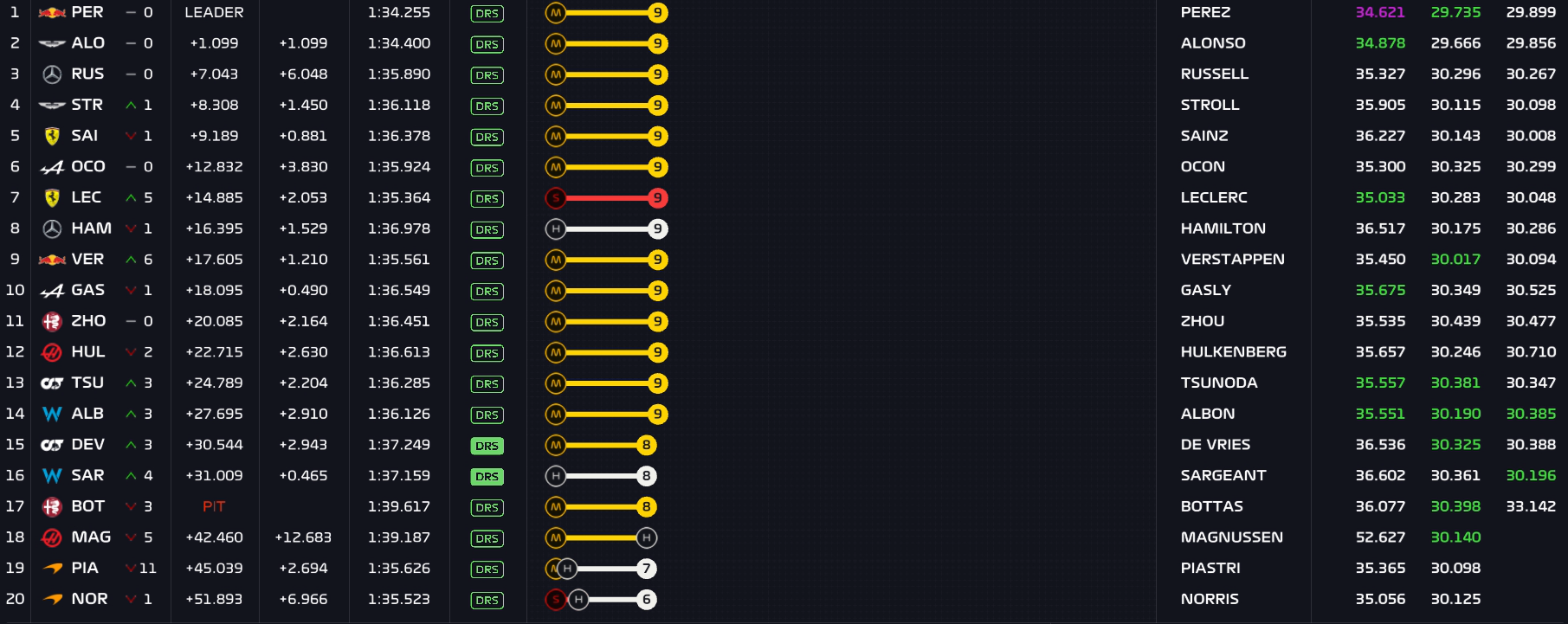

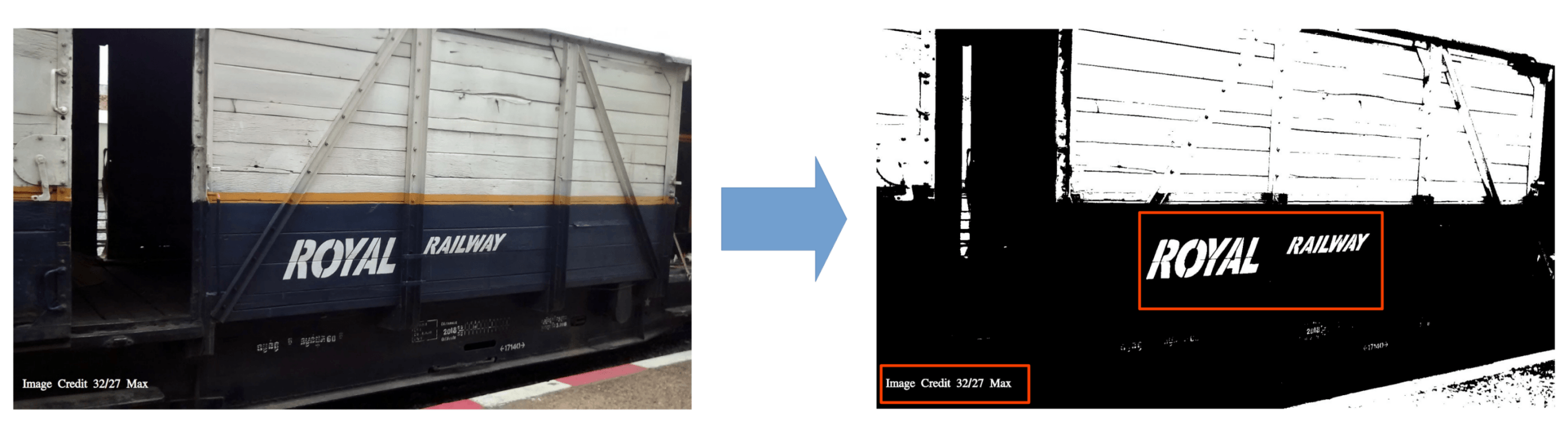

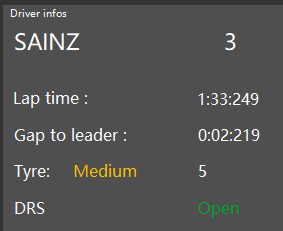

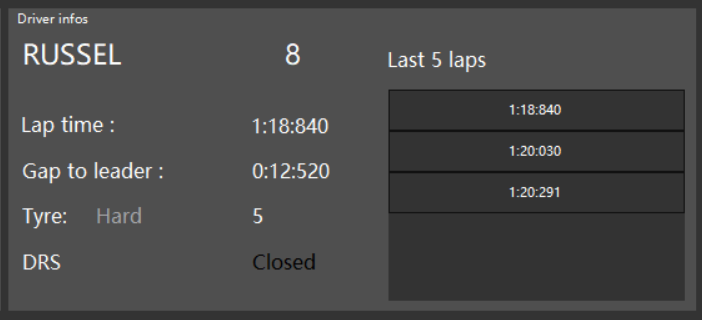

Ce dernier ressemble à cela :

(Attention, ce n'est pas un joli tableau HTML, mais bien une vidéo qui contient un tableau.)

Sauf que toutes les informations sont étalées pêle-mêle sans hiérarchie, ce qui fait que cela me prendrait trop de temps de tout déchiffrer à chaque fois, ce qui me fait rater des choses intéressantes.

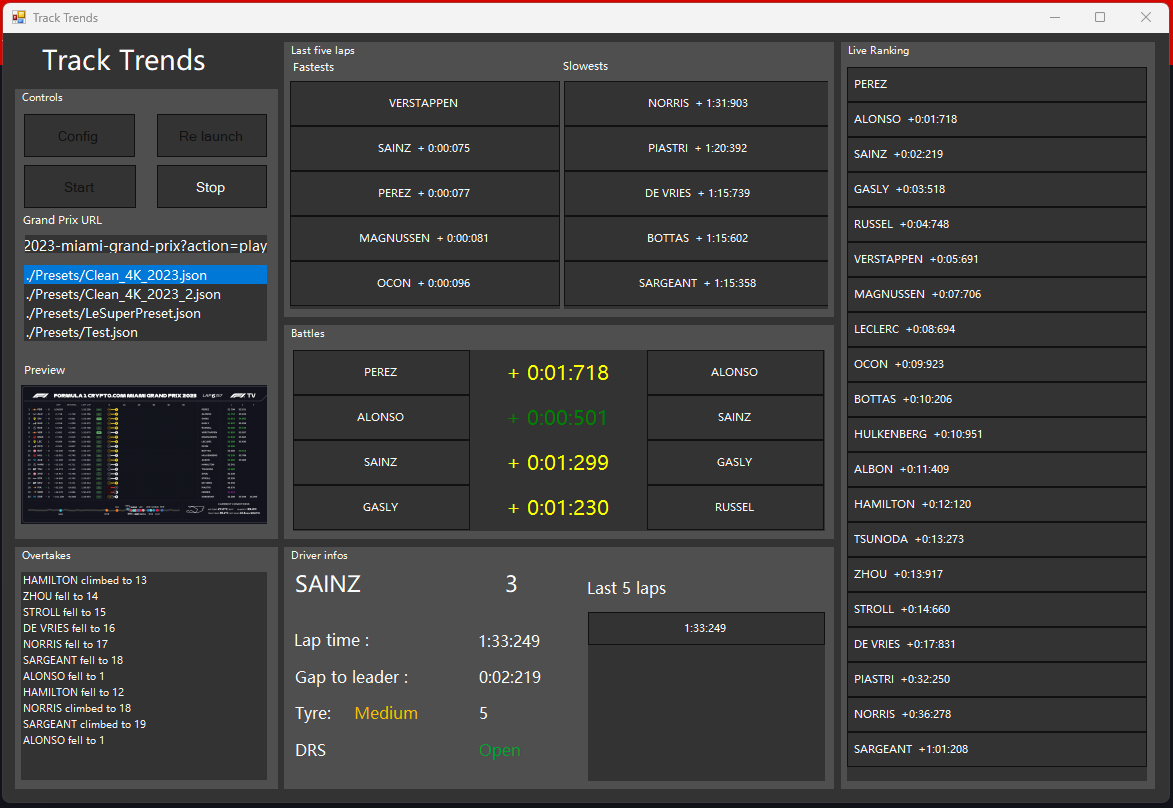

Le but du projet est donc de fournir un outil qui hiérarchise et affiche différemment les données pour faciliter leur lecture et me permettre de faire de meilleurs commentaires.

Abstract

Track Trends is a Formula 1 data is a tool that displays and interpret data.

To understand everything,first ,a little bit of context. In my free time I have multiple activities and one is to be the Live Ticker F1 for the local journal "20 minutes" (Owned by Tamedia). to help me in this work I'm currently using the F1TV to which I'm currently subscribed because it provides me with a better video feed with better commentary than the ones from the RTS (in my opinion) but also because it gives me access to a very important video feed : the data channel

You can see in the chapter above an example of the F1TV DATA CHANNEL.

[Note : Even tough it looks like a pretty HTML table on wich you could easely get infos... Its not. It's a video feed]

You can see a lot of data, all well and good BUT! All the data is displayed the same in a big table which make it really hard to read totally in a hurry, which means that I miss a lot of useful information.

The point of the project then is to provide a tool that can display those data by taking into account their relevance. So for example, a driver that is 10s away from everyone and that is doing some normal lap times will be less displayed or even not displayed at all, so I can focus on the drivers that are battling each others.

This tool would help me not miss the battles and details that are happening in the back and therefore not being broadcasted on TV. And it could be a useful tool for anyone who wants a better insight of how the race is going by looking at the data.

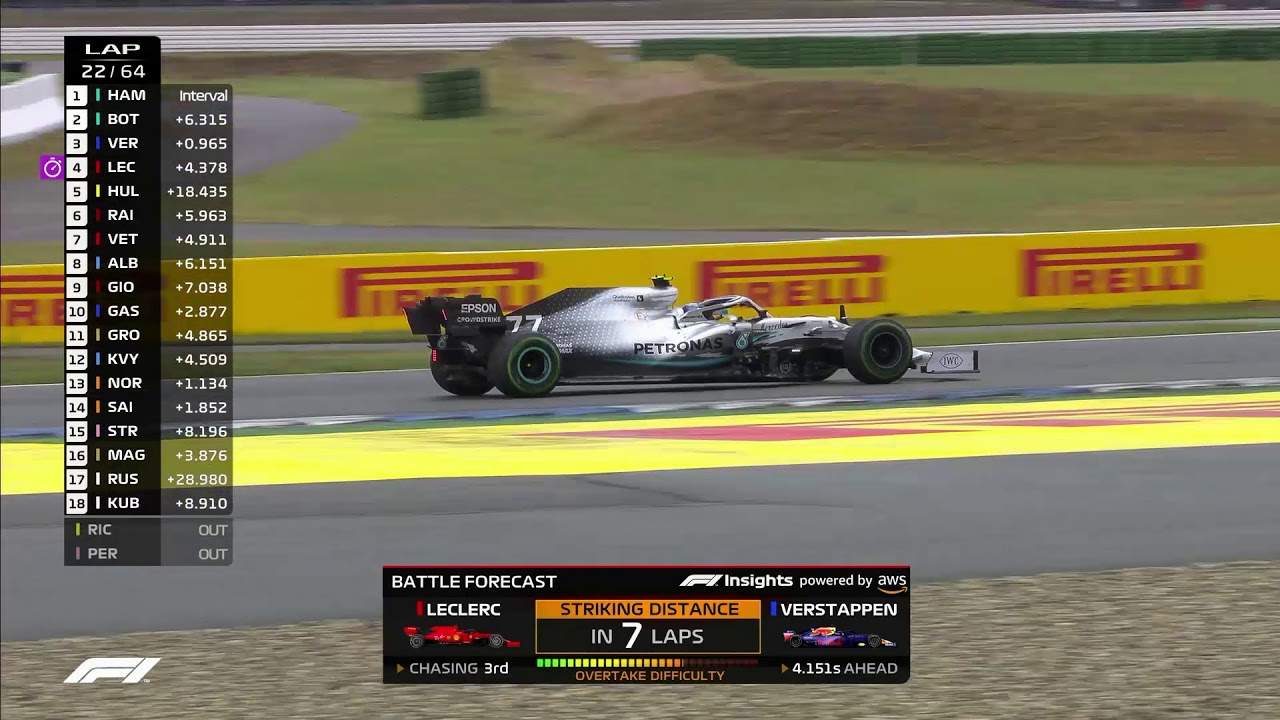

This kind of project already exists in the form of the AWS tool "F1 Insight" but it is not avaible to the public. We can only see some of its predictions (that are rubbish) and data dumps in the live feed when the TV directors feel like it.

Description du besoin

Comme expliqué dans le résumé, je suis Live Ticker F1. Mais pour mieux comprendre le besoin que j'ai, je pense qu'il est pertinent de comprendre comment je travaille.

Pendant un Grand Prix de Formule 1 j'ai plusieurs tâches à effectuer :

- Suivre les différents évènements du Grand Prix

- Changer le titre et la photo de titre du Live

- Chercher des Tweets ou des Images à intégrer

- Ecrire les commentaires en faisant attention à dire ce qu'il se passe mais aussi l’expliquer, ce que cela implique, mais aussi ce que cela veut dire pour le reste de la course.

- Comprendre et expliquer les stratégies

Tout cela toutes les cinq minutes max...

Cela veut dire que je dois être le plus rapide possible quand je cherche des informations. Et comme le tableau en comporte trop et bien, je suis obligé de le lire en diagonale.

Par exemple dans le tableau, les infos que je cherche le plus sont :

- Le nombre de places gagnées (surtout au départ)

- Les écarts entre les pilotes (surtout ceux qui sont en dessous de deux secondes).

- Les pneus de chaque pilote et combien de tours, ils ont fait dessus

- Les temps d'arrêts aux stands

- Les temps au tour (surtout pour la stratégie)

Mais pleins d'autres informations existent si on les recoupe sur plusieurs tours.

Un outil qui permettrait de mettre en évidence les informations importantes serait donc une très grosse plus-value pour mon travail et s'il est facile à installer et à utiliser, il se pourrait qu'il devienne indispensable.

Cahier des charges

Il s'agit d'une version coupée du cahier des charges qui ne contient pas l'explication du contexte. Mais l'original est disponible sur ce site également. Il est toutefois normal d'y voir des choses répétées ou légèrement différentes, en effet, il n'a pas été écrit en même temps que le reste de ce document.

Projet

Un outil de style compagnon sous forme d'application C# Windows Form qui récupère en temps réel les informations de la course et affiche les informations les plus importantes. Le but est non seulement de faciliter mon job, mais aussi faire en sorte d'améliorer la plus-value de mon travail en me permettant de fournir des commentaires qui ne sont pas disponibles pour le tout venant qui regarde simplement le flux RTS.

Exemples :

- Les pilotes qui sont proches (moins de 1-2 secondes qui sont donc en train de se battre).

- Les pilotes qui améliorent leur temps au tour et ceux qui perdent le plus de temps

- Le classement pondéré tenant compte des futurs arrêts au stand

Maintenant afficher différemment les infos, c'est sympa, mais cela serait encore mieux de traiter ces data et de permettre des petites prédictions.

Exemples :

- Prédire les arrêts aux stands en prenant en compte les baisses de performances des pneus

- Prédire le pneu que le pilote va chausser s'il rentre aux stands dans le prochain tour

- Prédire dans combien de tour tel pilote va rattraper tel autre pilote

- Prédire combien de temps le pilote va perdre dans les stands en fonctions des arrêts précédents

Réalisation

Malheureusement, la Formula 1 Management ne propose aucune API publique qui puisse nous permettre de faire ce projet "simplement". La raison la plus probable étant qu'Amazon avec son service AWS propose exactement ce genre de services pour le flux télévisé et il doit y avoir un contrat d'exclusivité.

Il existe des API "Pirates" faites par la communauté, le problème est qu'elles ne sont pas forcément des plus pratiques à utiliser.

Mais comme je possède un abonnement premium ++ à la F1TV, j'ai accès pour chaque grand prix à un flux vidéo nommé : DATA F1 CHANNEL

Qui ressemble à ça :

Donc la seule façon que je vois de récupérer ces données est de les prendre directement sur ce feed.

Même si le but final de l'application est de faire pleins de choses super avec les datas, le gros du projet va surtout être la récupération des données et leur stockage.

Les données viennent du flux vidéo et ainsi dans un premier temps, il va falloir récupérer d'une manière ou d'une autre des images qui viennent d'un grand prix en direct ou en rediffusion.

Ensuite, dans un second temps, il faut lire les informations directement sur l'image en utilisant une librairie prévue pour (exemple Tesseract) et vérifier l'intégrité de ces dernières pour qu'on puisse ensuite les stocker.

Dans un troisième temps, il faut stocker toutes ces données dans une forme qui permette d'aller facilement faire des requêtes de récupération et déjà préparer des méthodes qui permettent de récupérer des infos importantes (ex : la moyenne des cinq derniers tours, le temps moyen d'arrêt, etc.) pour faciliter la dernière étape

Quand tout cela est fait, on peut ensuite s'amuser un peu avec les Data.

La dernière étape est donc l'affichage. L'idée est de créer une Windows Form qui contienne toutes ces informations dans un format beaucoup plus lisible et avec laquelle on pourrait interagir pour permettre de plus facilement commenter les Grands Prix. (exemple plus bas avec un croquis de ce à quoi l'application pourrait ressembler)

Voici la liste des données qui pourraient être affichées (Non contractuel, simplement des idées).

- Les pilotes qui sont proches (moins de 1-2 secondes qui sont donc en train de se battre).

- Les pilotes qui améliorent leur temps au tour et ceux qui perdent le plus de temps

- Le classement pondéré tenant compte des futurs arrêts au stand

- La moyenne de temps que les pilotes perdent dans les stands

- La performance moyenne des 5 types de pneus

- La moyenne de temps de chaque pilote sur le pneu actuel

- Le nombre de points que chaque pilote gagnerait selon sa position

- Le classement de la course

Voire même si c'est possible :

- Prédire les arrêts aux stands en prenant en compte les baisses de performances des pneus

- Prédire le pneu que le pilote va chausser s'il rentre aux stands dans le prochain tour

- Prédire dans combien de tour tel pilote va rattraper tel autre pilote

- Prédire combien de temps le pilote va perdre dans les stands en fonctions des arrêts précédents

- Prédire les temps au tour de chaque pilote selon l'usure des pneus

Voici un exemple d'interface possible pour une page :

Cas d'utilisation

'*'On va considérer que tous les user ont un abonnement F1 TV PRO

Un user veut récupérer les data :

- Il ouvre son navigateur et lance la page DATA de la F1 TV

- Il calibre la capture des data via le programme (pour la première utilisation).

- Il confirme que les données initiales sont bonnes (pour la première utilisation).

- Il regarde tranquille son Grand Prix

Le programme récupère les data :

- Il récupère des images depuis la F1TV

- Il utilise Tesseract (ou autre) pour en récupérer les infos.

- Il met ces infos dans un Objet Pilote, dans un Objet course avec un attribut tour pour hiérarchiser les data

Pour ce qui est de l'affichage, l'idée est de faire une application C# comme on l'a appris à l'école, mais avec assez de style pour qu'elle puisse être agréable à utiliser.

Quand le programme affiche les data :

- Il prend les données venant directement de la F1TV.

- Il affiche différemment les données pour permettre une meilleure lisibilité

- Il interprète avec des règles plutôt simples certaines data pour faire des miniprédictions ou aider à la lecture

- Il récupère des infos d'autres courses pour les comparer et proposer des prédictions plus intéressantes

Difficultés techniques

- Récupérer un flux vidéo plutôt propre malgré les contres mesures de la F1 TV pour en empêcher la lecture par un logiciel

- Si on doit passer par une capture d'écran, trouver un moyen de stocker les données de manière à prévoir que parfois un tour pourrait avoir plus de données qu'un autre, que le user peut mettre pause, ou même qu’il revienne en arrière.

- Développer des algorithmes pour récupérer les données comme les différents pneus utilisés ou l'activation du DRS ainsi que développer des moyens de nettoyer les résultats de l'OCR (Par exemple utiliser différents champs redondants pour comparer les résultats)

- Stocker les données sur une base pour les traiter plus tard tout en prévoyant un moyen de voir les stats live

- Développer des algorithmes de prédiction qui prennent en compte d'anciennes courses pour tenter de prédire des choses comme les arrêts aux stands par exemple.

Différences sur le cahier des charges

Ici, je vais parler de l'état du projet à la date du 12 Juin 2023.

À cette date, le projet est fonctionnel, mais comporte quelques différences avec le cahier des charges original. Je vais expliquer non seulement ces différences, mais aussi les raisons qui font qu'elles sont là.

Pour bien comprendre les différences, il faut s'en référer au cahier des charges original.

L'application doit être "Un outil de style compagnon sous forme d'application C# Windows Form qui récupère en temps réel les informations de la course et affiche les informations les plus importantes". C'est ça la phrase la plus importante dans tout le CDC. Et je pense que très honnêtement, ce cahier des charges est rempli !

L'application actuellement disponible sur le repos GIT est une application de style compagnion Windows Forms qui récupère les infos de la F1TV en temps réel et elle affiche les informations qu'elle trouve importante. Donc, je dirais que l'objectif général est rempli.

Maintenant, c'est dans les détails que cela pêche.

Il est mentionné trois exemples d'infos à suivre, je cite :

- "Les pilotes qui sont proches (moins de 1-2 secondes qui sont ainsi en train de se battre)."

- "Les pilotes qui améliorent leur temps au tour et ceux qui perdent le plus de temps"

- "Le classement pondéré tenant compte des futurs arrêts au stand"

résultats :

- Dans l'application, on peut effectivement voir les pilotes proches (Ce sont ceux qui sont à moins de 3 secondes dans le version finale)

- Dans l'application, on peut aussi voir un affichage qui permet de voir les pilotes les plus rapides et les plus lents sur le circuit.

- On ne peut en revanche pas voir de classement pondéré selon les arrêts aux stands, car l'application a du mal à détecter des arrêts.

Ensuite pour ce qui est des prédictions, il n'y en a aucunes comme ça, c'est simple.

Si on ne regarde que de très loin le CDC et le projet final, on pourrait dire que c'est plutôt décevant puisqu'il manque beaucoup de choses comme les prédictions et certains affichages.

On peut aussi se dire ça en comparant la maquette du CDC et le résultat final.

Clairement, un œil non avisé pourrait être très déçu et pourrait dire que c'est un échec.

Et moi je vais vous expliquer pourquoi, au contraire c'est un total succès.

Déjà, la beauté de l'interface est très difficile à répliquer en Windows Forms et il faudrait plus d'une semaine de travail pour arriver à quelque chose qui pourrait ressembler un tout petit peu à la maquette.

Ensuite, si on regarde bien, on a quand même une application qui nous permet de suivre les informations de la course et qui calcule des choses à notre place. C'est déjà une grosse plus-value par rapport à la page Data de la F1TV.

Et finalement, les prédictions, les affichages et le style, ce sont les choses les moins compliquées du projet. On ne se rend pas compte que pour simplement afficher les 20 pilotes dans le bon ordre, il faut énormément de travail.

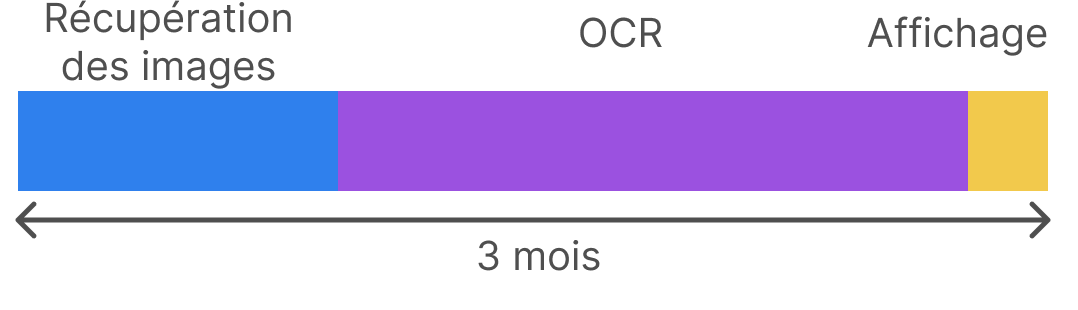

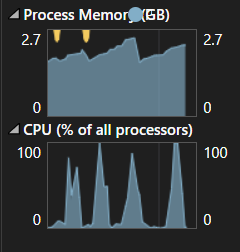

Voici une petite représentation graphique de la quantité de travail nécessaire pour en arriver à l'état actuel du projet :

Pour en arriver à un affichage, il a fallu récupérer automatiquement les images en utilisant un browser headless ce qui a pris un temps fou à mettre en place et il a fallu surtout lire les informations que l'on recevait des images.

J'ai passé presque 90 % du temps de mon projet à développer des choses qui permettront ensuite de faire de l'affichage.

Le fait qu'il y ait quoi que ce soit de logique qui s'affiche, cela veut dire que TOUT LE RESTE fonctionne ! Le moindre souci à la récupération des images, ou surtout à la reconnaissance de texte et de chiffres, et l'affichage est ruiné.

Si j'avais passé ne serait-ce qu'une semaine de plus juste sur l'affichage, le résultat final n'aurait rien à voir.

Le souci, c'est simplement que le cahier des charges ne parle pas du tout du reste du projet et ne parle que du résultat final.

Pour toutes ces raisons, je dirais que le CDC était trop superficiel, mais que l'application est conforme à l'idée générale de ce dernier et qu'il serait très facile de la rendre parfaitement conforme maintenant que tout le travail de fond a été fait et fonctionne et je pense donc que c'est un succès.

Planning prévisionnel

Mes suiveurs m'ont demandé un planning de type GANTT pour ce travail de diplôme

Je n'ai pas utilisé un logiciel particulier pour faire ce dernier, mais je me suis inspiré des principes fondamentaux d'un diagramme de ce type.

Comme l'original a été fait sur Excel, je ne peux pas vraiment l'insérer de manière lisible ici, mais il est disponible dans le dossier Planning.

Mais voici un résumé de son contenu :

Tâches

J'ai décidé de décomposer mon planning en trois grands types de tâches.

- Programmation

- Documentation

- Tests

L'idée est de permettre une meilleure lisibilité et de me permettre à moi de me faire plus facilement à l'idée de ce qu'il m'attend.

Voici la liste des tâches par rubrique :

PT

Cette rubrique contient les tâches qui n'ont pas leur place dans les trois catégories principales.

PT1 / préparation au travail de diplôme (2)

Cette tâche est un peu hors catégorie, mais c'est normal, c'est une supertâche qui regroupe beaucoup de choses. C'est une tâche qui est planifiée pour deux jours et qui normalement devrait être faite les deux premiers jours du travail.

Le but est de préparer tout ce qui peut être préparé en avance niveau documentation et mise en place pour ne pas avoir besoin de s'en soucier ensuite.

DT

Rubrique documentation qui contient toutes les tâches en rapport de près ou de loin avec la documentation du projet.

DT1 Création du poster (1)

Cette tâche consiste à faire une version numérique du poster qui soit en accord avec les consignes qu'on nous a données. Le but est aussi et surtout de faire poster dont je sois fier et que je sois content de montrer.

Il y a déjà des croquis de poster et j'ai clairement prévu de travailler sur ça pendant les vacances alors, je n'ai mis qu'un jour et je l'ai placé juste avant le rendu de ce dernier.

DT2 Documentation Analyse de l'existant (2)

Cette tâche est dédiée à l'écriture de la documentation et plus précisément de l'analyse de l'existant.

Comme il y a pas mal de technologies utilisées dans mon projet, j'aimerais faire correctement un vrai debrief de pourquoi j'ai utilisé l'une ou l'autre, alors, j'ai assigné deux jours dessus.

DT3 Documentation Analyse organique (5)

Cette tâche est la plus grosse dans la catégorie documentation. Il s'agit de documenter comment l'application fonctionne.

J'y ai mis cinq jours et je pense que c'est un minimum, car c'est dans cette tâche que je vais devoir détailler exactement comment fonctionne chaque partie du projet.

Ces cinq jours sont éparpillés sur le projet en général à la fin du développement de chaque grande partie de projet. Le but est de ne rien oublier et de ne pas avoir à tout faire en même temps.

DT4 Documentation Analyse fonctionnelle (2)

Cette tâche est déjà moins grosse, elle consiste à documenter le fonctionnement de l'application et comment utiliser les composants que j'ai développés.

Je l'ai mis en fin de projet, car comme j'ai l'habitude de faire des analyses fonctionnelles plutôt précises, le moindre changement dans l'UI peut tout rendre obsolète.

J'y ai mis deux jours, puisque j'aimerais correctement documenter avec de bonnes photos et scénarios pour qu'on puisse voir toutes les possibilités de l'application.

DT5 Documentation Tests (1)

Cette tâche est un peu plus petite qu'elle ne le devrait. Elle concerne la documentation des différents tests. Je n'y ai mis qu'un seul jour, car en réalité les différentes tâches de tests contiennent aussi beaucoup de documentation,

DT6 Documentation Reste (2)

Cette tâche est une tâche un peu vague. Elle contient toutes les actions autres que j'aurai besoin de faire (Mise au propre, orthographe, génération de PDF ...). J'y ai mis deux jours pour avoir un peu de marge, car ce sont toujours des tâches qui paraissent faciles, mais qui à la fin prennent beaucoup de temps si on les fait bien.

PT

Rubrique programmation qui contient toutes les tâches qui touchent à la programmation et au développement de l'application.

PT1 Programmation récupération des images (3)

Cette tâche est estimée à seulement trois jours, il ne faut pas s'y méprendre, c'est une des tâches les plus dures et lourdes au niveau de la documentation et en explications. Cependant, un POC (Proof Of Concept) assez avancé a déjà été fait et donc cela permet de n'envisager que trois jours, car il suffit de l'implémenter et de la peaufiner.

Cette tâche consiste à prendre en entrée un lien de Grand Prix et de sortir une image tous les x secondes de la page DATA. Cela peut sembler simple, mais pour le faire sans prendre d'espace d'écran et ne demandant pas à l'utilisateur de copier-coller quoi que ce soit où de donner ses identifiants F1TV c'est un challenge.

Cela peut paraitre curieux alors de mettre cette tâche loin dans le planning même si c'est la première étape du projet. Encore une fois, cela s'explique avec le fait qu'il y a déjà un POC qui fonctionne à peu près et que donc préfère commencer avec des tâches plus incertaines dans le cas où elles prendraient plus de temps que prévu.

PT2 Programmation OCR (5)

Cette tâche consiste à développer la partie qui reconnait le texte sur les images. C'est très certainement la tâche qui risque le plus de déborder, car c'est celle qui est la plus complexe techniquement puisqu'elle demande non seulement la lecture sur image, mais aussi le développement d'algorithmes de traitement de cette donnée pour être sûr qu'elle a bien été lue.

J'y ai ainsi alloué cinq jours, mais j'espère que j'arriverai à gagner du temps sur les autres pour y allouer plus dans le planning effectif, car je suis convaincu que plus, on y passe du temps, meilleur sera le résultat.

PT3 Programmation, stockage et modèle (5)

Cette partie est moins technique, mais concerne le stockage des données que nous retourne la lecture des images. Mais elle va demander de la réflexion et de l'intelligence de programmation, car il faut que cette partie anticipe les besoins de la vue et prépare un terrain fertile qui ne demande pas un refactor quand on passera au développement de la vue.

C'est pour cela que je lui ai aussi assigné cinq jours de travail et elle doit absolument être commencée après la lecture.

PT4 Programmation Vue de l'APP (5)

Cette partie peut être horrible comme très facile, cela dépend complètement de la qualité du travail avant. Si le modèle est parfait et que les données sont intègres, cela devrait être plutôt simple de les afficher de manière intéressante. Cependant, cette partie débordera sûrement un peu, car tout le temps gagné avec de bonnes données sera utilisé pour tenter de faire de la prédiction.

Pour ces raisons, je lui ai assigné également cinq jours de travail et elle doit absolument être faite après le modèle.

PT5 Programmation mise en commun (3)

Cette tâche est aussi un petit peu spéciale, car elle regroupe plusieurs choses. En gros, chaque partie de programmation sera assurément assez indépendante et il faudra à un moment faire un seul projet C# qui contient tout.

Il est difficile d'estimer à quel point cela va être compliqué alors, j'ai été conservateur et j'ai mis trois jours.

TT

Cette rubrique contient les tâches qui sont uniquement des tests. La plupart des tâches de programmations contiennent déjà des tests, mais certaines demandent une attention particulière.

TT1 Tests OCR (2)

Cette tâche est une des tâches les plus importantes. Son but est de faire un protocole de tests complet qui permette de comparer les différents algorithmes de reconnaissance de texte.

Je l'ai mise après la reconnaissance, mais même maintenant en écrivant ces lignes, je me dis que dans le planning effectif, elle sera faite pendant la tâche de programmation. En effet, comment savoir si mon tout nouvel algorithme est réellement mieux que le précédent.

Je prévois deux jours, car je pense que faire le dataset va prendre beaucoup de temps, il faut prévoir un certain nombre d'images et de texte qui pourront ensuite être données sous forme de tests. C'est certes une tâche de test, mais c'est aussi de la programmation.

TT2 Tests finaux (2)

Cette tâche de tests est un peu vague, elle regroupe les différents tests pour vérifier que les données sont bien affichées correctement. Ce qui serait cool si j'ai du temps en fin de travail de diplôme serait de faire un système de test qui permet d'entrainer le programme à mieux reconnaitre certaines choses comme des arrêts aux stands si on lui donne les trois dernières années de grands Prix.

J'ai mis une durée arbitraire de deux jours, mais je ne sais pas vraiment combien de temps cela va vraiment durer. Elle est évidemment à effectuer une fois que tout est à peu près terminé.

Planning effectif et différences

Alors !

Ces lignes sont écrites dans les derniers jours du travail de diplôme et j'ai des choses à dire.

Premièrement, je suis plutôt content de mon estimation du travail. Je trouve que j'ai bien estimé la quantité de travail et combien de temps les différentes tâches allaient prendre. La plupart des dépassements sont des imprévus et/ou des allers et des retours entre d'autres tâches.

La raison pour laquelle je suis plutôt content de ma planification, c'est que malgré l'usine à Gaz que représente ce projet et le nombre de soucis que j'ai eu, j'ai quand même pu arriver à un projet qui fonctionne en suivant essentiellement fidèlement le planning. Une chose dont je suis assez fier, c'est la documentation. En ayant développé le squelette de l'app dès le début du projet, ça m'a permis d'avancer au fur et à mesure du projet la conscience tranquille.

Bon, c'est bien joli les fleurs, mais clairement, c'est loin d'être parfait. Au moment de la planification, je n'avais pas prévu de faire des allers et des retours entre plusieurs tâches. Dans le planning effectif, on peut voir qu'un jour, je suis sur la PT3 (Stockage) et la PT5 (regroupement des mini projets en un seul gros). J'aurais peut-être dû inverser l'ordre.

Mais il y a deux gros soucis dans mon planning :

- L'ordre des tâches n'était pas bon (mais il a été décidé comme ça pour que les plus grosses difficultés soient faites en premier) ce qui a créé pas mal de soucis. Ex : L'émulateur de la F1TV a été fait très tard et finalement les images récupérées n'étaient pas de la même qualité que ce que j'avais prévu en développant l'OCR en premier.

- Les Tests ont été négligés et utilisés comme des jours tampons. Ça, c'est la plus grosse erreur de planning. Autant les autres sont pénibles, etc. mais n'ont pas forcément compromis la bonne réalisation du projet alors que les tests ont été mal placés et ont finalement été balayés tandis que s'ils avaient été mieux planifiés ça ne serait pas arrivé.

Solutions :

L'ordre des tâches a été décidé exprès de cette façon pour éviter de prendre trop de risques. L'idée était qu'en faisant le plus dur au début, je pourrai facilement changer le cahier des charges. J'ai envie de dire que j'aurais dû être plus confiant, mais pour être honnête, je pense que c'était un mal pour un bien. Je ne pense pas avoir "bien" fait, mais je pense que c'est une erreur qui était rentable pour mon niveau de stress dans le projet.

Par contre, les Tests c'est tout simplement une erreur. J'en parle plus en détail dans la partie test de la documentation, mais je vais résumer un peu ici. La documentation a été faite dès le début du projet. J'ai mis en place le squelette pour qu'ensuite, il soit simple d'y ajouter au fur et à mesure. J'aurais dû faire exactement pareil avec les tests. Si j'avais fait au moins le squelette des tests au début du projet, j'aurais pu beaucoup plus facilement en faire et cela m'aurait fait gagner un temps fou et j'aurais même pu faire du TDD (Test Driven Developpement). Je suis persuadé que cette bête erreur de planification m'a coûté très cher, car ne pas avoir une bonne stratégie de tests a dû me faire perdre un temps fou.

Pour conclure, je suis content parce que j'ai réussi à rendre un projet qui marche en suivant assez bien le planning, mais il y a des choses que je vais devoir changer dans mes prochains projets.

Analyse fonctionnelle

Voir "Manuel Utilisateur" tout y est indiqué

Analyse Organique

Outils utilisés

Visual Studio 2022

C'est l'application que j'ai le plus utilisé, je pense. Visual Studio 2022 est l'IDE officiel de Microsoft pour coder en C#.

C'est l'outil que j'utilise depuis maintenant six ans au CFPT et franchement, il fait tout ce que je pourrais vouloir. C'est aussi un outil pratique pour utiliser Windows Forms et faire des applications natives Windows.

Pas grand-chose à dire à ce sujet à part que c'est un outil qui marche bien et qui est gratuit si on prend la community édition.

Visual Studio Code

Cet outil est déjà un peu plus intéressant. C'est le second outil que j'ai le plus utilisé. J'en ai surtout eu besoin pour écrire de la doc, mais aussi pour coder en python et pour contrôler mkdocs.

Visual Studio est un IDE absolument génial qui est très puissant avec les bonnes extensions. Je l'utilise au quotidien pour tout ce qui est développement WEB, Mobile ou pour éditer des fichiers de configs pour mes drones ou imprimantes 3D. Je peux même compiler le firmware pour ces dernières en utilisant une extension faite pour.

Les possibilités de customisation sont presque infinies et c'est un plaisir d'utiliser ce logiciel gratuit fourni par Microsoft, mais qui est amélioré constamment par des développeurs indépendants.

Je conseille à n'importe quel développeur de l'essayer à moins qu'il soit uniquement sur C# ou il serait plus intéressant d'utiliser visual studio 2022.

Material/Mkdocs/Markdown

Pendant ce projet, j'ai utilisé exclusivement du Markdown avec l'aide de Mkdocs et Materials.

Le choix de Markdown a été plutôt simple, c'est une façon facile et efficace de créer de la documentation et on n'avait pas le choix de l'utiliser.

On avait également l'obligation (Ou au moins un très forte incitation) par nos professeurs d'utiliser mkdocs et materials pour que notre documentation ne soit pas simplement une liste de fichiers, mais un joli site dans lequel il est agréable de chercher des informations.

Mkdocs et Materials sont deux outils vraiment fantastiques, mais je dois avouer que je n'ai pas assez mis de temps pour apprendre tout leur potentiel. Pour moi ce sont simplement des outils et je veux qu'ils marchent. Je ne suis pas forcément du genre à aller changer toutes les couleurs et polices pour avoir la doc parfaite, j'ai préféré passer du temps sur mon app. Mais même si ces outils offrent une customisation très avancée, il est très facile de créer un projet simple et j'aime beaucoup cette simplicité.

J'ai eu pas mal d'aide de la part de M. Briard pour implémenter certaines features et je l'en remercie très chaudement, car sans son aide ce document serait sûrement un peu moins commode à lire (Oui oui ça aurait pu être pire, je sais, c'est dur à imaginer).

Figma

Figma est l'outil que j'ai utilisé pour créer mon poster et un certain nombre des diagrammes de cette documentation.

J'utilise aussi cet outil dès que je vais faire des maquettes de sites ou d'applications. D'ailleurs les maquettes dans le cahier des charges ont été faites avec.

C'est un outil en ligne parfaitement gratuit qui conserve tout dans le cloud. Franchement, je n'ai rien à dire, je n'ai pas utilisé plus de 15 % des features que cet outil propose et je suis déjà conquis.

Technologies utilisées

Dans ce projet, différents choix ont été faits pour ce qui est des technologies.

Certaines ont été choisies, car elles étaient les plus simples, les plus pratiques, les plus efficaces ou encore les plus connues et donc ayant le meilleur support. Je vais tenter de résumer ici ces choix, mais je reviendrai sur la plupart d'entre eux plus tard quand j'explique ce que je fais avec.

Selenium

Selenium est une librairie à la base Node JS qui permet d'automatiser des actions sur un navigateur internet. Le but premier et je pense son utilisation première et l'automatisation de tests pour des applications WEB. En effet, c'est un super outil pour simuler un user faisant un certain nombre d'actions sans apporter de variabilité, ce qui fait de super test unitaires.

Cependant, je pense que l'autre grande partie des utilisateurs de Selenium l'utilisent pour faire du "Scrapping". Et nous sommes un peu dans cette seconde catégorie. Le "Scrapping" c'est l'acte d'aller récupérer des informations sur des pages web automatiquement pour alimenter sa propre base de données. En effet, si on arrive à passer les protections anti-bot, on peut facilement utiliser Selenium pour scraper tous les sites qui nous passent par la tête.

Le cahier des charges que j'avais en tête en cherchant une technologie de contrôle de navigateur internet était le suivant :

- Simple

- Permettant de contrôler un navigateur Headless (Voir chapitre "Simuler un navigateur ?")

- Permettant de contrôler Firefox

- Ayant un wrapper C#

- Permettre de changer certaines choses comme les cookies en direct

- Permettre d'interagir avec les éléments d'une page

- Fonctionner

Simple, car je ne voulais pas avoir à passer trop de temps dessus (ça n'a pas bien vieilli lol...). Je voulais que l'on puisse utiliser Firefox parce qu'il n'implémente pas les mêmes sécurités que Chrome pour faire simple. J'avais besoin que la lib puisse contrôler un Firefox HEADLESS comme je ne voulais pas avoir une page web ouverte sur mon ordi quand je commente, car c'est de l'espace utilisé pour rien. J'avais besoin d'un wrapper C# puisque c'est le langage que j'utilise. Pour finir, j'avais besoin d'interagir avec les éléments de la page pour naviguer dessus et d'insérer des cookies pour me connecter sans avoir à passer par le login de la F1TV qui est très bon pour détecter les bots.

Avec un cahier des charges pareil beaucoup de librairies ont été abandonnées. J'ai pu tester pleins de librairies C# qui arrivaient à contrôler un Chrome et même pas mal qui arrivaient à contrôler un Chrome Headless. Mais le choix est très vite restreint quand on veut pouvoir contrôler Chrome OU Firefox.

À la base, mon choix, c'était porté sur Puppeteer Sharp qui est une librairie qui se veut être exactement ce que je veux.

Je voulais utiliser cette librairie, car il y a des plugins qui sont très orientés scrapping, en effet, ils implémentent de nombreuses techniques pour permettre de mieux passer inaperçu par les systèmes de détection de bots.

Sur le papier, c'est la librairie parfaite qui correspond parfaitement au cahier des charges que je m'étais fixé et je pense que si j'utilisais un projet JS, elle le serait. Sauf qu'avec le wrapper C# j'ai eu un certain nombre de problèmes :

- Toutes les versions de la librairie ne fonctionnaient pas. Il fallait faire des tests avec différentes versions de la librairie et de ses dépendances simplement pour faire lancer un browser. Et ça, c'est quand ça marchait, car il y avait des jours où des machines sur lesquelles je n'ai juste pas pu faire fonctionner la librairie.

- Même avec les techniques proposées par les plugins "Stealth" je n'arrivais pas à bypass les sécurités de la page de login de la F1TV. J'ai essayé tout ce que j'ai pu trouver sur internet, mais on se fait toujours chopper dès que l'on arrive sur la page.

- Et le pire de tous, impossible de faire fonctionner une vidéo. J'ai pu faire tout ce que je voulais faire finalement en passant par l'utillisation de cookies pour la connexion. Tout ça pour arriver au moment où il faut lancer la vidéo, et là, crash. Impossible de faire fonctionner Puppeteer Sharp avec une vidéo. Dès qu'elle se lance, c'est un crash assuré sans message d'erreur clair. Et le souci, c'est que le wrapper C# n'est pas vraiment bien supporté et que si c'est un bug de la lib, je ne risque pas de voir de fix avant un moment si ce n'est jamais.

Pour toutes ces raisons, j'ai dû abandonner cette librairie, ce qui a été très dur, car j'avais passé beaucoup de temps dessus à essayer de la faire marcher.

Ensuite le choix de Selenium était plutôt simple, c'était la seule option restante. À ce jour, je ne connais aucune autre librairie que Puppeteer ou Selenium qui puisse contrôler un Firefox Headless en respectant mon cahier des charges et qui soit donc disponible depuis C#.

Si je n'arrivais pas à faire fonctionner Selenium, j'aurais dû abandonner l'idée de simuler un navigateur tout simplement. Mais j'ai eu la chance que cette librairie fasse tout ce que je pouvais demander. C'est une super lib et même si la version C# n'est vraiment pas bien documentée, la plupart des documentations de la version JS sont pertinentes pour la version C# même si ça n'est pas la même syntaxe.

Pour résumer, j'ai choisi Puppeteer car c'était la seule option viable pour mon besoin.

(Note : Par contre si je trouve la personne chez Mozilla ou puppeteer qui a décidé d'hard coder la résolution maximale du browser Headless que l'on peut override UNIQUEMENT en changeant les variables d'environnement de la machine ET DE NE LE DOCUMENTER QUASI NULLE PART JE JURE QUE CA VA TRÈS MAL SE PASSER)

CSharp

Je pense que c'est le choix le plus simple à expliquer. C# est un langage de programmation orienté objet relativement haut niveau qui a été créé par Microsoft et qui a comme cible le développement d'applications pour Windows. (On peut évidemment trouver des adaptations pour le faire tourner sur Linux, mais ce n'est pas vraiment le but du langage)

En plus d'être un superbe langage de programmation, c'est le langage que l'on apprend au CFPT informatique. C'est donc un langage avec lequel je suis beaucoup plus à l'aise que pour d'autres langages comme le Python ou le JS.

Mon but n'était pas de faire une application Web et je travaille sous Windows. Je savais que mon projet allait demander un minimum de programmation orientée objet. J'ai ainsi immédiatement pensé à utiliser C#.

Cependant, j'aurais très bien pu utiliser un langage comme python qui m'aurait clairement facilité la tâche avec des librairies bien plus fournies et plus souvent mises à jour. Mais comme je ne suis pas du tout aussi à l'aise avec, je pense que le C# était la meilleure option. Mes seuls regrets après coup sont que je trouve les Windows Forms très moches et qu'il est particulièrement difficile de les rendre plus jolies et que les librairies disponibles en C# pour des scénarios très précis ne sont pas au niveau de celles pour JS et pour Python. Cependant, si j'avais à refaire le projet, je reprendrais C# je pense.

Python ?

Alors ce choix-là est plus compliqué à comprendre.

Pour tout le projet, j'ai tenté de garder le C# comme langage et de ne pas utiliser autre chose. Cependant, j'ai dû utiliser une seule fois le Python dans un cas très précis.

Je n'aime vraiment pas coder en python de base et clairement, j'aurais préféré ne pas l'utiliser, mais je n'avais pas le choix.

Le besoin dans le cas du python était le suivant :

J'avais besoin d'un moyen de récupérer des strings et les décoder avec une clé encodée avec le système propriétaire de Windows d'encodage.

Le souci, c'est que j'avais avec le C# c'est que les méthodes de décryptions ne fonctionnent pas pareil qu'en python et tous les exemples que je pouvais trouver étaient en python. J'ai essayé pendant un sacré moment de faire fonctionner la décryptions en C# mais sans succès.

J'ai donc directement utilisé le python comme faisait toutes les personnes que je pouvais voir sur internet et je pense que ça n'est pas une mauvaise idée. En effet, cela veut dire que si à un moment Chrome est mis à jour, je n'aurai pas besoin d'aller ouvrir tout le code source de mon projet pour tout recompiler, j'aurai simplement besoin de changer ce script.

Un des avantages du Python est quand même qu'il y a beaucoup plus de gens qui codent dessus, et pour ce genre d'utilisation très spécifique, c'est plutôt pratique.

Le seul problème, c'est que cela oblige l'utilisateur à avoir python installé sur sa machine et que sa version doit être compatible... (les joies de python).

Firefox

J'en parle déjà plus bas, mais le choix de navigateur est super important.

Déjà tous les navigateurs n'ont pas un mode Headless (sans tête, mieux expliqué dans la rubrique "Simuler un navigateur ?"). Par exemple, même si Edge est maintenant basé sur Chromium, il n'existe pas de moyen de le faire tourner en Headless pour le moment.

Autre souci, les librairies d'automatisation ne supportent pas tous les navigateurs. Par exemple, beaucoup supportent chrome, mais très peu supportent Firefox ou Edge. Donc, il me fallait un navigateur qui puisse opérer en Headless et qui soit supporté par plusieurs librairies d'automatisation.

Il n'y a que Firefox et Chrome qui soient conformes à ces exigences. (Je n'ai pas vérifié pour TOUS les navigateurs. Peut-être que les Opera GX ont aussi un mode headless super, mais je me suis concentré sur les navigateurs plus grand public).

Chrome est supporté par plus de lib, mais le souci c'est que la F1TV utilise un lecteur de vidéo avec DRM (Plus d'infos là-dessus dans la partie "Simuler un navigateur ?") et donc le choix était simple. Il ne restait que Firefox.

Tesseract

Je pense que le choix le plus simple après le C# fut l'utilisation de Tesseract.

C'est tout simplement l'outil le plus utilisé pour faire de l'OCR. À la base, c'est une lib Python (Ah tiens encore ?) qui peut être redoutablement efficace avec le bon dataset.

Il existe d'autres outils, mais j'ai décidé de prendre celui-là à cause de son support juste incroyable et de son omniprésence dans la documentation OCR.

En plus il est facile à utiliser et je ne pense pas encore avoir fait le tour de tout son potentiel dans ce projet.

Fonctionnement général

Avant de passer à l'explication de chaque partie du projet en détail, je pense qu'il est important de faire un petit point sur comment toutes les parties du projet s'emboitent et fonctionnement ensemble. Comme ça, quand vous lirez l'explication d'une étape, vous serez conscient de à quoi elle sert, et où elle s'inscrit dans le projet principal.

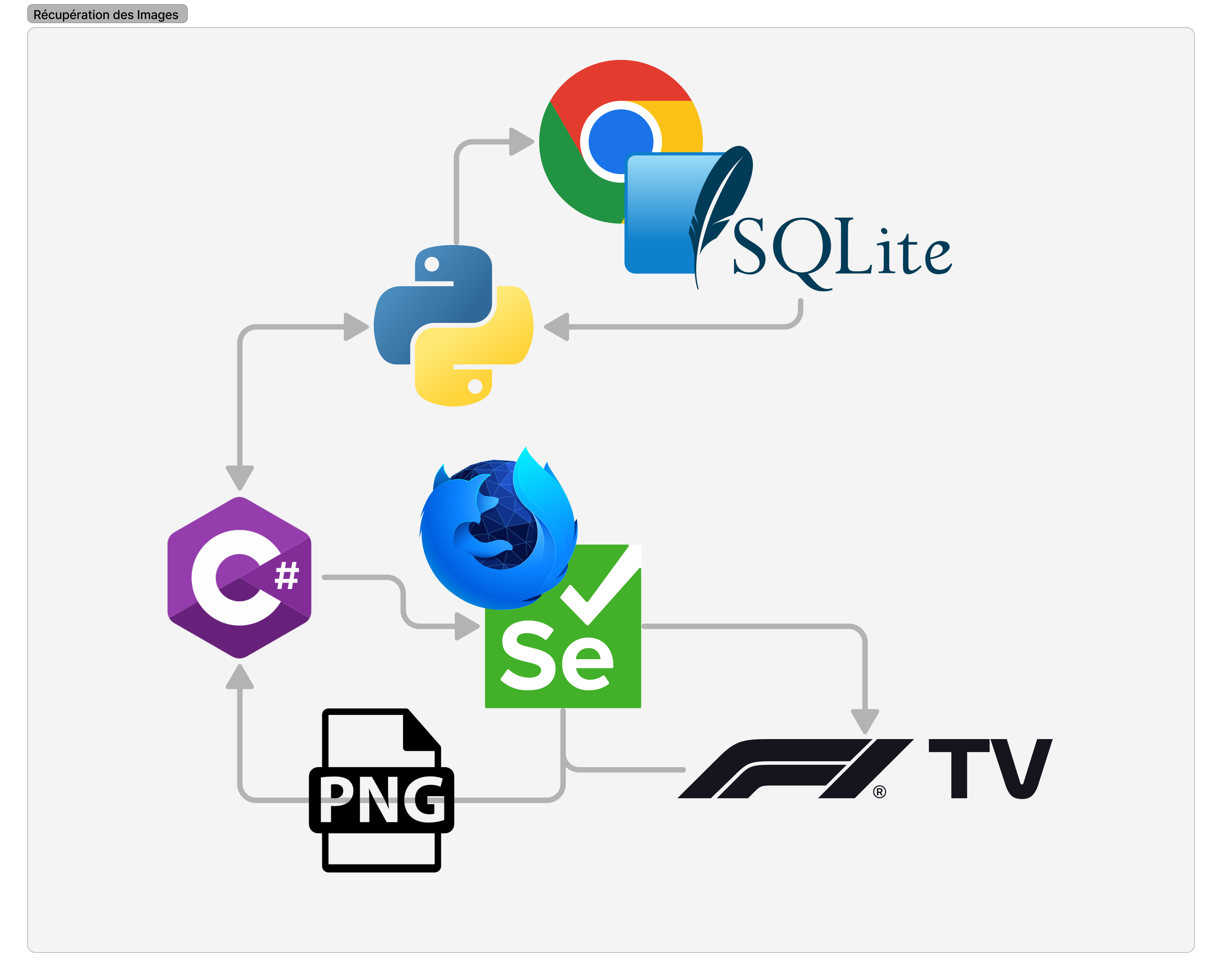

Les briques principales

Voici trois grosses étapes du projet. Pour rappel, ce sont des vulgarisations plutôt larges qui n'ont qu'un seul but, aider à la compréhension de ce qui vient par la suite.

Récupération d'images

Pour faire simple, on peut voir qu'il y a deux parties à cette étape. La première en partant du haut représente un script python qui va chercher des informations dans la base de données de Chrome qui est en SQLite. Ces informations dans notre cas sont les cookies de connexion.

Dans la seconde étape, on peut voir que le programme utilise Selenium avec un navigateur Firefox Headless qui va aller communiquer avec la F1TV qui est le site web qui nous intéresse et qu'une des infos que l'on récupère est une image de la page en format PNG que l'on envoie au programme C#.

Ces deux parties sont liées, car pour se connecter à la F1TV Selenium a besoin des cookies de connexion récupérés par le programme Python.

La première partie est un processus qui n'est utilisé qu'une seule fois au démarrage tandis que la récupération d'images et en continu pendant toute la durée de l'utilisation de l'application.

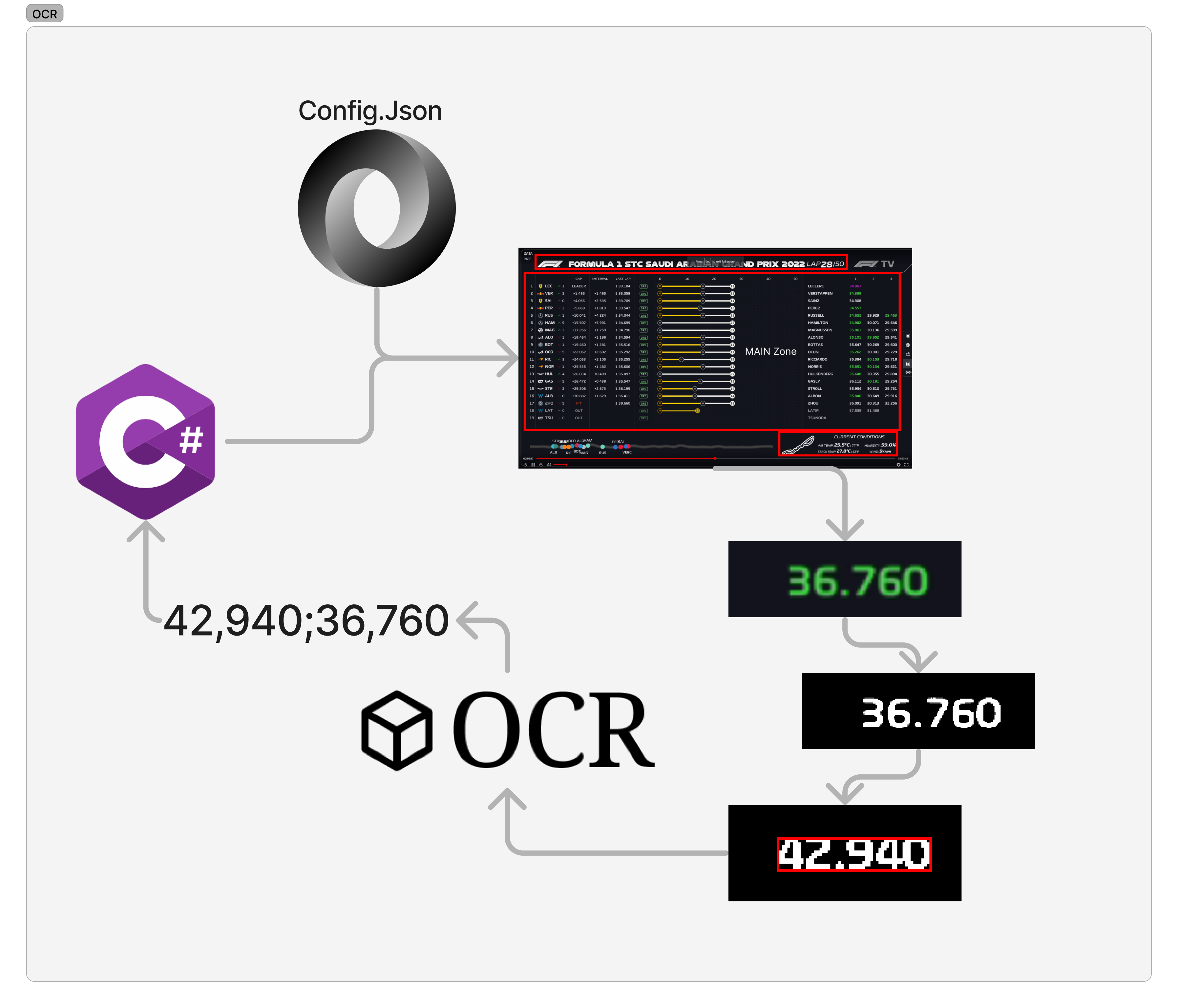

OCR

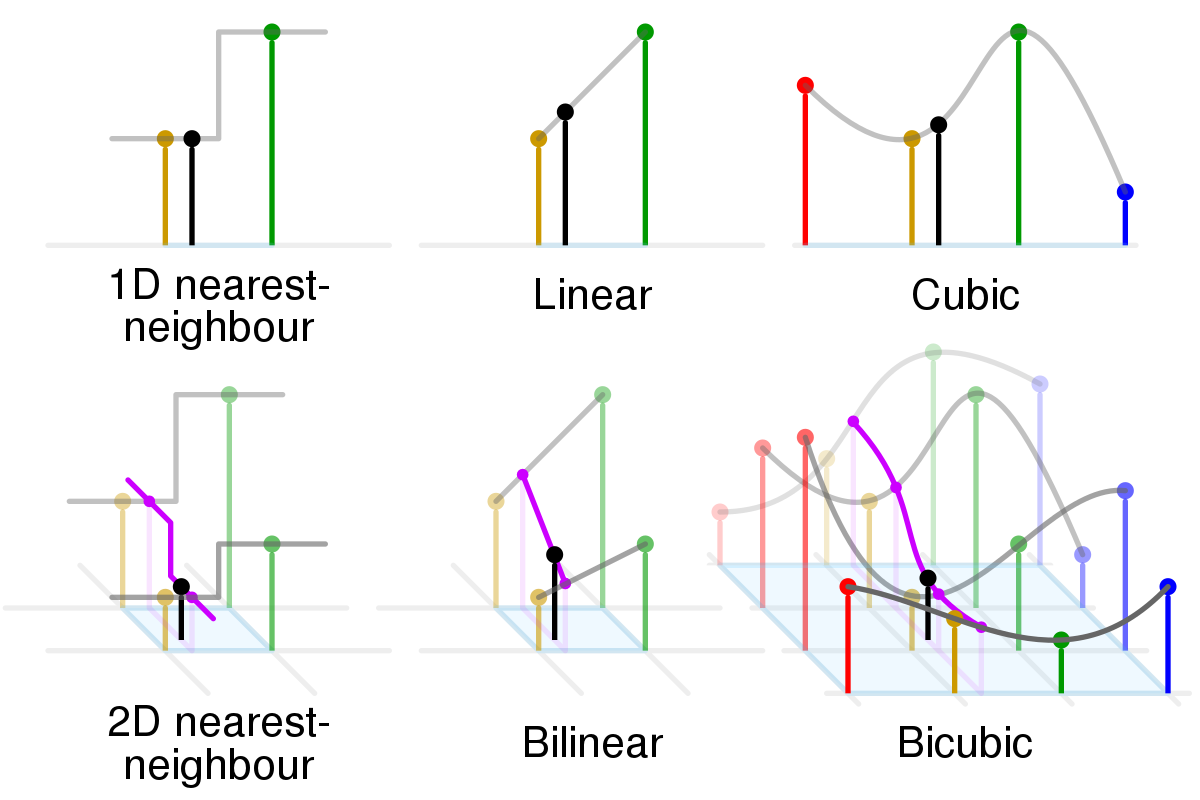

On peut voir dans ce diagramme simplifié qu'avec l'aide de ce que contient le fichier "Config.JSON" on découpe l'image que l'on a récupéré au préalable en petits morceaux qui contiennent des informations. Ensuite, on prend cette image et on lui applique un filtre pour retirer le flou, la couleur, etc. Puis en utilisant de l'OCR (Optical Character Recognition) on en récupère les informations sous forme de texte et on le renvoie dans le programme C#

Dans cette partie explicative générale, on ne reviendra pas sur la création de ce fichier config. Pour plus d'infos à son sujet, voir la rubrique (OCR/Fonctionnement général)

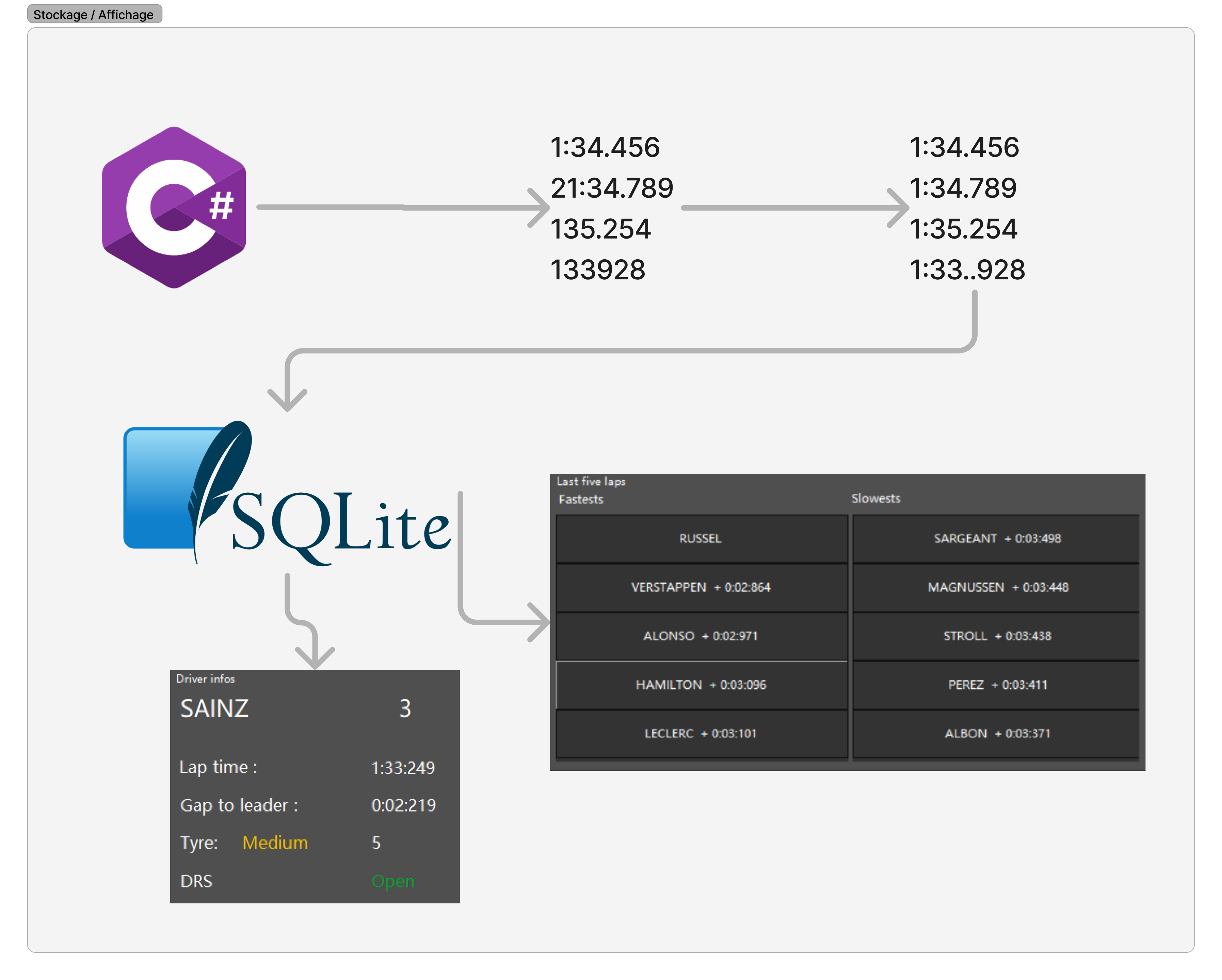

Traitement et affichage

On peut voir dans ce dernier mini diagramme simplifié qu'on prend les données que l'on récupérait de l'étape précédente qui ne sont pas forcément toutes cohérentes et qu'on les traite pour leur redonner du sens avant de les stocker dans une base de données SQLITE. Ensuite cette même base de donnée fournis les infos nécessaires pour des affichages (Ces affichages sont directement récupérés depuis le projet en cours de fonctionnement).

Résumé du fonctionnement général

Ce dernier diagramme est un schéma fait pour représenter de la manière la plus simple possible toutes les briques du projet et comment elles s'imbriquent ensemble. La représentation est un peu différente des trois autres diagrammes, car le but ici est surtout de montrer le chemin que fait la donnée à travers les couches.

Toutes les parties du projet ne sont pas incluses, notamment la partie calibration dans un objectif de simplifier la lecture.

Dans l'ordre, on peut voir que pour la partie récupération d'images, le python va récupérer les cookies dans la base de données chrome pour ensuite les retourner à Selenium.

Selenium va ensuite pouvoir lancer un navigateur (en l'occurrence Firefox) et utiliser les cookies récupérés pour aller sur la page de la F1TV qui va retourner un certain nombre d'infos à Selenium.

L'info qui nous intéresse le plus depuis Selenium ce sont les images de la page data de la F1Tv et ce sont elles que l'on va envoyer dans la partie LOAD du diagramme.

Dans cette partie, on prend l'image de la F1TV et on la découpe selon les directives données par le fichier Config.JSON (il renseigne les zones à découper et ce qu'elles représentent) et après le découpage, on se retrouve avec une zone principale, vingt zones de pilotes et 9 fenêtres de données par zone de pilote donc 180 fenêtres en tout.

Ces fenêtres sont ensuite envoyées pour être filtrées (retirer le flou, mettre en évidence les caractères, en gros les préparer pour la reconnaissance) dans la partie OCR

Dans cette partie, après avoir filtré les images, on les envoie à Tesseract pour qu'il nous retourne des résultats d'OCR. Ces résultats sont ce que Tesseract a trouvé sur les images et ils sont retournés sous la forme de Data Pilote. Ex (Position : 1,Tour : 45, Temps au tour : 1:34.683, Pneus : Medium etc....)

Finalement, ces données ont envoyées dans la partie traitement qui va faire des vérifications d'usage pour s'assurer qu'elles sont correctes et quand c'est fait, tout est envoyé dans une base de données SQLite.

On ne montre pas non plus dans ce diagramme la parte affichage des données, car je ne trouve pas pertinent de l'inclure ici.

Et voilà, c'est le fonctionnement très général et simplifié de l'application. Je vous invite à continuer à lire cette documentation pour des informations plus précises à propos de toutes ces étapes. Bonne lecture !

Récupération des images

Voici la première grande étape du projet.

Pour rappel, Amazon héberge directement le site de la F1TV et possède les droits sur les données de la F1. C'est sous le nom de AWS (le service d'hébergement d'Amazon) que la firme apparait en tant que sponsor.

On peut voir ce nom apparaître assez souvent quand on regarde un Grand Prix, car comme ils ont la mainmise sur les données, ils peuvent insérer des bandeaux d'informations sur le flux public sur ce qu'il se passe, voir même faire des prédictions (Bien qu'un peu bancales)

Ce service s'appelle F1 Insights (Oui, c'est un meilleur nom de projet que F1 Compagnon, mais bon) et c'est, je pense, la raison pour laquelle on ne voit aucune API publique qui permette de correctement se renseigner en données en direct pendant un Grand Prix. Ils ont dû dégotter un juteux contrat pour s'occuper de toute l'infrastructure digitale de la F1 (du moins publique) en échange d'une exclusivité totale sur certaines choses comme les Data.

Évidemment, je ne fais que conjecturer et ce que j'ai dit n'est pas à prendre au pied de la lettre, mais c'est une explication possible, je pense, de pourquoi il est si difficile de trouver des données sur la F1 facilement en temps réel.

Il existe bien quelques API un peu bancales publiques, mais le problème, c'est qu'elles ne sont vraiment pas suffisantes et je ne peux pas leur faire confiance quand je commente. Ce qu'il m'aurait fallu, c'est une API publique et officielle qui me permette d'être sûr que les données sont les bonnes et qu'elles arrivent le plus vite possible.

On pourrait croire que c'est impossible, car cela n'existe pas comme je l'ai dit MAIS ! Ce n'est pas complètement vrai. En effet, depuis que je possède un abonnement à la F1TV, il existe une source d'informations très précieuse qui m'aide énormément dans mon quotidien de commentateur de Formule 1. La "DATA CHANNEL".

La Data Channel est une page de la F1TV qui permet, pour chaque Grand Prix, de visualiser, sous la forme d'un flux vidéo, différentes informations capitales sur la course.

Le problème, c'est que comme je viens de le dire, ces données ne sont pas accessibles comme un tableau HTML ou un flux RSS ou un tableau JSON. C'est un flux vidéo. Il faut savoir qu'entretenir une diffusion de flux vidéo en 1080P pendant deux heures accessible par des milliers d'abonnés est EXTRÊMENT cher, surtout quand on le compare à simplement afficher les données dans un tableau. Ce qui veut dire que ce choix est délibéré et a un sens au niveau économique. Je pense donc que c'est justement pour éviter que des petits malins puissent juste venir scraper l'intégralité des données qu'ils proposent et fasse sa propre API. (C'est d'ailleurs un des sites avec la meilleure protection anti-bot du monde)

MAIS ce n'est pas par ce que les données ne sont pas faciles à avoir qu'elles sont IMPOSSIBLE à avoir. Et c'est là que ce projet entre en jeu. Mais pour décoder les données d'une image, il faut d'abord ... (roulement de tambours) ... Avoir des images !

Et c'est là que vient se glisser cette partie du projet.

Comment faire ?

Le but de ce segment est de se concentrer sur la récupération et la mise à disposition, pour le reste du programme, des images en direct de la F1TV dans la meilleure qualité possible et dans les meilleurs délais.

Pour ce faire, il y a plusieurs solutions :

- Reverse engeneer la F1TV pour accéder directement au flux sans passer par la plateforme internet et pouvoir prendre images à volonté.

- Avoir tout simplement une page de la F1TV ouverte sur un écran et prendre des screenshots à intervalles réguliers.

- Simuler un navigateur internet sans qu'il soit affiché et le contrôler automatiquement pour qu'il prenne des captures.

La première option aurait été la plus élégante, mais lors d'un POC que je tentais de réaliser, je me suis rendu compte que cela serait un peu trop compliqué et long à faire. Sans compter le fait que les rediffusions de Grand Prix ne sont pas gérées de la même manière que les diffusions en direct. Et que pour faire des Tests en direct, il faudrait attendre à chaque fois un weekend de Grand Prix et le faire en plus du commentaire que je dois produire.

Pour toutes ces raisons et bien d'autres, je l'ai rangée dans la case "Trop dur, Trop chiant, Sûrement illégal" (Oui, je sais, c'est une catégorie bien spécifique, mais c'est ma documentation, je fais ce que je veux).

La troisième option aurait été la plus simple (et moins drôle) et je suis presque sûr que je peux implémenter cette dernière en moins d'une après-midi. Sauf qu'elle apporte de gros soucis.

- On ne peut pas garantir l'intégrité et la continuité des données si l'utilisateur avance ou fait pause, même par simple inadvertance.

- La moindre fenêtre qui s'afficherait devant ruinerait toute la reconnaissance de caractères.

- On ne peut pas contrôler la qualité du flux et on est obligé de faire confiance en l'utilisateur

- On ne peut pas vraiment automatiser quoi que ce soit niveau tests ou même pour faire du scrapping auto pour remplir une base de donnée.

- Et finalement le pire inconvénient : C'EST NUL ! Je ne pourrais jamais utiliser un projet qui fonctionne de cette façon, je ne peux pas me permettre d'avoir un écran inutilisable quand je commente et auquel je dois constamment faire attention pour ne pas perturber la reconnaissance. Pour moi, cette option aurait été celle à choisir en cas d'extrême urgence et en dernier recours, car le projet deviendrait inutile.

J'ai donc décidé de m'occuper de la seconde option : Simuler un navigateur.

Cette option, bien que complexe et difficile à implémenter, propose une solution à tous les problèmes et permet une récupération quasi sans compromis.

Simuler un navigateur ?

Simuler un navigateur internet n'est pas forcément très difficile. Chromium par exemple offre une panoplie d'outils natifs et énormément de librairies existent permettant de facilement et en quelques lignes simuler un Google Chrome et le contrôler sans afficher son UI (Interface Utilisateur).

Cependant, La F1TV n'utilise pas simplement un player HTML5 basique. Elle utilise un service de streaming Bit Movin qui permet de fournir un stream de bonne qualité et surtout qui implémente les DRM (Digital Right Management).

Cela veut dire que quand on ouvre un flux de la F1TV sur chrome et que l'on essaie de prendre une capture d'écran, le player se met en noir et ne permet pas de voir quoi que ce soit (Certaines versions de Chrome le permettent pendant quelques semaines avant de bloquer à nouveau). Ce qui dans notre cas est un immense problème. Mais Firefox ne nous bloque pas de cette façon et il est donc assez facile de passer outre.

L'explication sans trop rentrer dans les détails est la suivante :

Dans Chrome, le player par défaut utilise une technologie appelée "PCP" ou "Protected Content Playback" qui leur permet de bloquer au moins une partie des techniques de récupération du flux vidéo et audio.

Cependant, Firefox de pas sa nature Open Source utilise "Open H264" pour lire ces mêmes flux soumis à des DRM et Open H264 n'implémente pas les mêmes restrictions.

Sauf que Firefox n'est pas aussi facilement émulé que chrome et cela réduit notre choix de librairies à ... Une seule… Qui est Selenium. (Il existe aussi Pupetteer C# mais j'ai rencontré énormément de soucis avec cette dernière dès que je voulais lancer une vidéo)

Mais même si la documentation est plutôt maigre parfois, c'est une bonne librairie qui permet de très bien contrôler une instance de chrome ou de Firefox.

Contrôler le navigateur

Maintenant que l'on sait quel navigateur simuler et avec quelle technologie, on peut passer à la réalisation.

Ce qu'il y a de bien avec Selenium, c'est qu'on a un certain nombre de commandes très haut niveau qui nous permettent de contrôler un navigateur de manière plutôt précise.

Je vais décrire ici la procédure habituelle utilisée sous une forme de recette de cuisine pour que l'on puisse simplement comprendre ce qu'il se passe.

Durant cette explication, je vais parler à un moment de Cookies, ne vous en faites pas, c'est le sous-chapitre suivant qui va vous en parler.

Recette de cuisine pour récupérer des images de la F1TV :

- Démarrer une instance de navigateur avec les bons arguments

- Ajouter les bons paramètres pour ne pas se faire flag comme un bot

- Naviguer sur la page de la F1TV

- Ajouter les cookies de connexion pour avoir accès au contenu de la page

- Naviguer sur la page du Grand Prix demandé

- Attendre un peu que la page se charge

- Cliquer sur l'invite de cookies

- Attendre cinq secondes le temps que la page se reload

- Cliquer sur le bouton qui permet de passer du feed live à la DATA CHANNEL

- Appuyer sur Espace pour faire apparaitre le bouton d'accès au paramètres

- Cliquer sur le menu déroulant des résolutions

- Trouver l'option 1080P et la sélectionner

- Cliquer sur le bouton qui met la vidéo en plein écran

- Prendre de screenshots à intervalles réguliers

Pour faire toutes ces actions, on doit récupérer les éléments selon leur ID ou leur classe.

Voici un exemple qui récupère le bouton de plein écran et qui clique dessus :

IWebElement fullScreenButton = Driver.FindElement(By.ClassName("bmpui-ui-fullscreentogglebutton"));

fullScreenButton.Click();

Ça peut paraître plutôt simple dit comme ça et quand tout fonctionne ça l'est, mais la difficulté vient du fait qu'à peu près n'importe laquelle de ces étapes peut rater et qu'il faut donc faire un bon système de gestion d'erreurs qui puisse aider l'utilisateur en cas de problème.

Parfois, il est aussi difficile de trouver un élément selon son ID, sa classe, ou sa value.

Par exemple, l'option qui permet de passer en 1080P peut avoir comme value 1080_9011456 ou 1080_9011200 si on refresh la page. Cela demande de passer par des expressions régulières, ce qui n'est pas compliqué en soi, mais ce sont toutes ces petites choses qui rendent le processus long à mettre en place.

Il faut dire aussi que les sites ne sont pas forcément très contents de voir des bots passer, car cela peut être un risque de DDOS et de Scraping (Comme moi) et donc ils mettent en place des systèmes pour nous empêcher de faire ce que l'on veut.

On peut utiliser différentes techniques pour passer outre ces restrictions comme :

- Changer son User Agent

- Changer sa résolution

- Ne pas avoir des patterns trop prévisibles

- Avoir un historique

- Ne pas cliquer pile sur le milieu des boutons

- Ne pas cliquer trop vite

- Passer par un proxy pour ne pas se faire flag

- Utiliser des librairies plus discrètes

J'ai eu l'occasion de tester toutes ces méthodes pour tenter de passer derrière les radars de la F1TV et visiblement, j'ai réussi pour les pages principales, mais pas pour les pages de Login.

Il faut savoir que la bataille entre bots et propriétaires de sites est un grand jeu du chat et de la souris et que les plateformes innovent constamment leur sécurité. Et il se trouve que la partie login de la F1TV est hébergée autre part que le reste du site chez Amazon et qu'elle possède les meilleures sécurités que j'aie pu voir. Aucunes des méthodes que j'ai citées et d'autres encore que j'ai essayé n'ont réussi à fourvoyer le système.

J'ai donc été obligé de faire appel à la connexion par Cookies pour pouvoir accéder au reste du site internet.

Récupérer les cookies ?

Alors, on va mettre de côté toutes les questions de sécurité et de violation de la vie privée et de protection des données des utilisateurs pour ce chapitre. Car pour faire simple, je siphonne TOUS les cookies de la personne qui utilise mon app.

Alors évidemment ça n'est pas pour faire des bêtises avec et c'est pour une "bonne" raison, mais bon quand même ça peut faire bizarre comme ça.

Je pense que vous savez déjà ce qu'est un Cookie, mais je vais malgré tout faire un petit point là-dessus, car c'est important pour la suite.

Quand on va sur un site internet et que l'on se connecte avec nos identifiants, nous sommes connectés sur la session.

Cependant, si on quitte le site ou que l'on ferme le navigateur, le site ne peut pas garder en mémoire que c'est bien vous quand le lendemain, vous retournez dessus. Pour palier à cette limitation, on a inventé cette chose magnifique (hem...) que sont les cookies !

Les cookies sont des petits fichiers qui sont stockés dans votre navigateur et qui peuvent servir à beaucoup de choses comme traquer votre activité sur internet et espionner un peu ou aussi par exemple, servir de jeton de connexion.

L'idée est que quand vous vous connectez sur le site avec vos identifiants, le site envoie un petit fichier dans votre navigateur qui va servir de jeton. Et donc lorsque vous reviendrez, le site pourra voir que vous avez le jeton et vous connectera automatiquement.

Ça peut paraître génial, et c'est effectivement bien pratique, cependant ce n'est pas sans risques. En effet, imaginons qu'un acteur malveillant parvienne à s'emparer de ces petits fichiers, il pourrait ainsi facilement se faire passer pour vous. Alors un cookie expire à un moment donné pour tempérer les risques, mais ils sont toujours présents.

Dans notre cas, on peut vite comprendre pourquoi cela peut être intéressant de récupérer ces cookies. En effet, si on peut mettre la main sur le jeton de connexion de l'utilisateur de notre application. On pourra se connecter automatiquement à la F1TV et aller prendre des photos directement sans que l'utilisateur ait à faire quoi que ce soit.

Sauf que les cookies ne sont pas stockés en clair comme ça. Évidemment, Google Chrome a mis en place quelques techniques pour éviter que n'importe qui puisse s'amuser à aller taper dans les cookies de la machine.

Tous les cookies sont stockés dans une base de données SQLite avec les noms en clair et les valeurs sont encryptées en utilisant la méthode AES 256 qui est une méthode de cryptage très utilisée et efficace.

Tellement efficace qu'il serait complètement inutile de tenter de les décrypter en utilisant de la force brute pour trouver la valeur ou même une attaque de dictionnaire ou quoi que ce soit.

Si ces valeurs peuvent être encodées et décodées en local sur la machine sans connexion internet, cela veut dire que la clé est stockée sur la machine. Et si je peux mettre là, mais sur cette clé, alors je pourrai lire tous les cookies de la machine.

Cette clé est stockée dans les fichiers de Google Chrome sous Google\Chrome\User Data\Local State. Et dans ce fichier, on peut trouver une liste de données en clé valeurs et on peut trouver la clé sous os_crypt encrypted_key. On pourrait croire que l'on a déjà touché le jackpot, mais il reste encore une étape. Cette clé est cryptée en utilisant le système d'encryption de Windows. Cette encryption est utilisée pour empêcher des utilisateurs non connectés d'accéder à certaines données. Mais comme nous sommes connectés, nous pouvons facilement utiliser les librairies de décryptions pour trouver la valeur de cette clé.

Et à partir de là, il suffit d'utiliser cette clé pour décrypter tous les cookies de la machine pour aller chercher ceux qui nous intéressent.

Voici un exemple du code python qui permet d'aller chercher la clé d'encryption dans les fichiers de Google Chrome :

def get_master_key():

with open(

os.getenv("localappdata") + "\\Google\\Chrome\\User Data\\Local State", "r"

) as f:

local_state = f.read()

local_state = json.loads(local_state)

master_key = base64.b64decode(local_state["os_crypt"]["encrypted_key"])

master_key = master_key[5:] # removing DPAPI

master_key = win32crypt.CryptUnprotectData(master_key, None, None, None, 0)[1]

print("MASTER KEY :")

print(master_key)

print(len(master_key))

return master_key

Python ?? Et oui j'ai choisit d'utiliser un srypt python pour aller chercher les cookies.

Ce choix a été fait pour trois raisons :

- Le python est un language que je n'aime pas particulièrement mais qui possède un éventail de librairies absolument fantastique. Et pour ce genre de choses qui demandent une constante mise à jour des librairies et qui sont un peu niches le python est une option juste géniale.

- Comme c'est une des parties qui est le plus suceptible de changer vu que Chrome change relativement souvent le système de stockage des cookies. Dans une optique de facilité de maintenance, avoir un seul fichier qui concerne cette partie du projet et qui est dans un language que plus de gens maitrisent que C# est pratique.

- Je n'ai pas réussi à trouver de librairies C# qui me donne des résultats identiques à celles que j'utilise dans ce script python.

Pour faire la liaison entre le C# et le python, j'appelle le script depuis mon C# et ensuite le python s'occupe de mettre tous les cookies dans un CSV qui est ensuite lu depuis le C#.

Voici la partie python qui écrit dans le csv :

if not cookies_path.exists():

raise ValueError("Cookies file not found")

with sqlite3.connect(cookies_path) as connection:

connection.row_factory = sqlite3.Row

cursor = connection.cursor()

cursor.execute("SELECT * FROM cookies")

with open('cookies.csv', 'a', newline='') as csvfile:

fieldnames = ['host_key', 'name', 'value', 'path', 'expires_utc', 'is_secure', 'is_httponly']

writer = csv.DictWriter(csvfile, fieldnames=fieldnames)

if csvfile.tell() == 0:

writer.writeheader()

for row in cursor.fetchall():

decrypted_value = decrypt_password(row["encrypted_value"], master_key)

writer.writerow({

'host_key': row["host_key"],

'name': row["name"],

'value': decrypted_value,

'path': row["path"],

'expires_utc': row["expires_utc"],

'is_secure': row["is_secure"],

'is_httponly': row["is_httponly"]

})

print("Finished CSV")

Et la partie C# qui appelle le script et qui lit le CSV :

private void StartCookieRecovering()

{

string scriptPath = PYTHON_COOKIE_RETRIEVAL_FILENAME;

Process process = new Process();

process.StartInfo.FileName = "python.exe";

process.StartInfo.Arguments = scriptPath;

process.StartInfo.UseShellExecute = false;

process.StartInfo.RedirectStandardOutput = true;

process.Start();

string output = process.StandardOutput.ReadToEnd();

process.WaitForExit();

}

public string GetCookie(string host, string name)

{

StartCookieRecovering();

string value = "";

List<Cookie> cookies = new List<Cookie>();

using (var reader = new StreamReader(COOKIES_CSV_FILENAME))

{

// Read the header row and validate column order

string header = reader.ReadLine();

string[] expectedColumns = { "host_key", "name", "value", "path", "expires_utc", "is_secure", "is_httponly" };

string[] actualColumns = header.Split(',');

for (int i = 0; i < expectedColumns.Length; i++)

{

if (expectedColumns[i] != actualColumns[i])

{

throw new InvalidOperationException($"Expected column '{expectedColumns[i]}' at index {i} but found '{actualColumns[i]}'");

}

}

// Read each data row and parse values into a Cookie object

while (!reader.EndOfStream)

{

string line = reader.ReadLine();

string[] fields = line.Split(',');

string hostname = fields[0];

string cookieName = fields[1];

if (hostname == host && cookieName == name)

{

value = fields[2];

}

}

}

return value;

}

Maintenant que l'on sait comment simuler et manipuler un navigateur internet, que l'on sait comment se connecter sur le compte F1TV de l'utilisateur sans qu'il n’aie rien à faire. On a tous les ingrédients pour automatiquement récupérer des images de la F1TV du Grand Prix que l'on souhaite.

Calibration

Maintenant que l'on a des images de la page Data de la F1TV, on pourrait croire que c'est tout bon, on peut direct passer à la partie OCR. Mais que nenni !

Le gros souci de l'OCR c'est que sa précision est grandement réduite dès que l'on augmente la taille de la zone de recherche. Même simplement deux mots sur une image, si on les prend dans les images individuelles, on a de grandes chances de trouver quelque chose, mais si on les met les deux sur la même et qu'on tente l'OCR, on va avoir de résultats bien moins bons.

Et puis il faut aussi voir que selon les données que je cherche, je ne peux pas faire le même traitement.

Par exemple, savoir si le DRS est allumé, savoir quels pneus chausse un pilote et depuis combien de tours et savoir quel est le temps de son dernier tour, ce sont des informations qui demandent des traitements qui n'ont rien à voir.

Il faut donc pouvoir dire au programme d'OCR ou se trouvent les informations et quelle est leur nature pour qu'il puisse les décoder.

Il faut donc faire une calibration qui puisse donner toutes les infos importantes, mais qui en même temps soit facile à utiliser, car un utilisateur doit être capable de le faire assez facilement.

Voici la liste des informations que l'on doit récupérer :

- La liste des pilotes présents sur le Grand Prix

- La position de la zone principale

- La position de chaque zone de pilote

- La position de toutes les Windows sur chaque zone de pilote

Le but a été de retirer le plus d'étapes possibles à l'utilisateur. Techniquement, j'aurais pu faire une version complètement manuelle, mais ça aurait pris trop de temps, alors il y a des systèmes qui permettent de rendre cette tâche moins pénible.

Liste des pilotes

Pour la liste des pilotes, j'ai pensé à utiliser une API externe pour avoir une liste dans laquelle on pourrait sélectionner des noms de pilotes, sauf que j'ai abandonné l'idée, car je trouvais que le projet avait déjà bien assez de points qui dépendent de l'extérieur.

Il y a donc une liste de pilotes dans laquelle on peut ajouter ou supprimer des noms de pilotes. L'idéal serait de mettre tous les pilotes de réserve, comme ça si un pilote est malade sur une course, on n'a pas besoin de venir changer la liste.

Zone principale

Pour la zone principale, c'est entièrement manuel, on attend de l'utilisateur deux points x, y sur l'image pour ensuite avoir une idée d'où est censé se trouver la zone.

Zones pilotes

C'est là que ça devient intéressant. L'utilisateur n'a pas besoin de faire quoi que ce soit pour que le programme sache où sont les zones des pilotes.

J'aurais pu le faire manuellement en faisant choisir à l'utilisateur de donner deux points qui correspondent à la première zone et extrapoler pour en avoir 20. Sauf que si l'utilisateur n'est pas précis au pixel près (et même comme ça parfois) le vingtième pilote se retrouve avec une zone complètement désaxée.

Là, le programme va "simplement" effectuer une reconnaissance de texte sur toute l'image. Les résultats ne nous intéressent pas vraiment, tout ce que l'on veut, c'est la position des textes.

Avec les positions, il est facile de déterminer où sont toutes les zones de pilotes et donc sans que l'utilisateur ait à toucher quoi que ce soit, dès qu'il a donné les infos pour la zone principale, les zones de pilotes sont déterminées.

Voici un exemple du code utilisé pour trouver ou dessiner des zones de pilotes :

public void AutoCalibrate()

{

List<Rectangle> detectedText = new List<Rectangle>();

List<Zone> zones = new List<Zone>();

TesseractEngine engine = new TesseractEngine(Window.TESS_DATA_FOLDER.FullName, "eng", EngineMode.Default);

Image image = MainZone.ZoneImage;

var tessImage = Pix.LoadFromMemory(Window.ImageToByte(image));

Page page = engine.Process(tessImage);

using (var iter = page.GetIterator())

{

iter.Begin();

do

{

Rect boundingBox;

if (iter.TryGetBoundingBox(PageIteratorLevel.Word, out boundingBox))

{

//var text = iter.GetText(PageIteratorLevel.Word).ToUpper();

//We remove all the rectangles that are definitely too big

if (boundingBox.Height < image.Height / NUMBER_OF_DRIVERS)

{

//Now we add a filter to only get the boxes in the right because they are much more reliable in size

if (boundingBox.X1 > image.Width / 2)

{

//Now we check if an other square box has been found roughly in the same y axis

bool match = false;

//The tolerance is roughly half the size that a window will be

int tolerance = (image.Height / NUMBER_OF_DRIVERS) / 2;

foreach (Rectangle rect in detectedText)

{

if (rect.Y > boundingBox.Y1 - tolerance && rect.Y < boundingBox.Y1 + tolerance)

{

//There already is a rectangle in this line

match = true;

}

}

//if nothing matched we can add it

if (!match)

detectedText.Add(new Rectangle(boundingBox.X1, boundingBox.Y1, boundingBox.Width, boundingBox.Height));

}

}

}

} while (iter.Next(PageIteratorLevel.Word));

}

//DEBUG

int i = 1;

foreach (Rectangle Rectangle in detectedText)

{

Rectangle windowRectangle;

Size windowSize = new Size(image.Width, image.Height / NUMBER_OF_DRIVERS);

Point windowLocation = new Point(0, (Rectangle.Y + Rectangle.Height / 2) - windowSize.Height / 2);

windowRectangle = new Rectangle(windowLocation, windowSize);

//We add the driver zones

Zone driverZone = new Zone(MainZone.ZoneImage, windowRectangle, "DriverZone");

MainZone.AddZone(driverZone);

//driverZone.ZoneImage.Save("Driver" + i+".png");

i++;

}

}

Windows pilotes

C'est ici que c'est le plus pénible pour l'utilisateur, il doit sélectionner manuellement les positions des fenêtres de données. Ensuite, dès que l'utilisateur a donné une position pour chaque window, on applique les positions pour chaque zone de pilote.

Il y a plusieurs types de windows et selon le type le traitement est différent comme je l'ai dit plus tôt. Voici des exemples concrets :

Il est important que toutes ces zones soient transmises avec le plus de précision possible pour que l'OCR puisse bien faire son boulot.

Stockage

Ensuite, quand l'utilisateur a fini de configurer son flux, la configuration est stockée pour qu'il puisse ensuite la réutiliser pour tous les autres Grand Prix de l'année.

Le stockage est fait sous format JSON et est fait pour que le programme d'OCR puisse lire dedans toutes les infos nécessaires.

Cela fait des fichiers plutôt gros, mais je n'avais pas vraiment le choix. J'ai testé une version avec seulement les infos de la première zone de pilote, mais avec l'interpolation, les derniers pilotes se retrouvent avec des zones clairement pas à la bonne taille.

Voici un exemple de ce à quoi ressemble le JSON final :

{

"Main": {

"x": 36,

"y": 343,

"width": 3780,

"height": 1454,

"DriverZones": [

{

"name": "Driver1",

"x": 0,

"y": 1,

"width": 3780,

"height": 72,

"Windows": [

{

"Position": {

"x": 45,

"y": 3,

"width": 76,

"height": 65

},

"GapToLeader": {

"x": 447,

"y": 1,

"width": 206,

"height": 67

},

"LapTime": {

"x": 863,

"y": 3,

"width": 229,

"height": 65

},

"DRS": {

"x": 1095,

"y": 1,

"width": 174,

"height": 67

},

"Tyres": {

"x": 1274,

"y": 3,

"width": 1448,

"height": 62

},

"Name": {

"x": 2724,

"y": 3,

"width": 361,

"height": 65

},

"Sector1": {

"x": 3088,

"y": 1,

"width": 239,

"height": 65

},

"Sector2": {

"x": 3314,

"y": 4,

"width": 190,

"height": 62

},

"Sector3": {

"x": 3493,

"y": 1,

"width": 198,

"height": 67

}

}

]

},

{

"name": "Driver2",

"x": 0,

"y": 72,

"width": 3780,

"height": 72,

"Windows": [

{

"Position": {

"x": 45,

"y": 3,

"width": 76,

"height": 65

},

"GapToLeader": {

"x": 447,

"y": 1,

"width": 206,

"height": 67

},

"LapTime": {

"x": 863,

"y": 3,

"width": 229,

"height": 65

},

"DRS": {

"x": 1095,

"y": 1,

"width": 174,

"height": 67

},

"Tyres": {

"x": 1274,

"y": 3,

"width": 1448,

"height": 62

},

"Name": {

"x": 2724,

"y": 3,

"width": 361,

"height": 65

},

"Sector1": {

"x": 3088,

"y": 1,

"width": 239,

"height": 65

},

"Sector2": {

"x": 3314,

"y": 4,

"width": 190,

"height": 62

},

"Sector3": {

"x": 3493,

"y": 1,

"width": 198,

"height": 67

}

}

]

}

[Other pilots...]

],

"Drivers": [

"Perez",

"Verstappen",

"Alonso",

"Sainz",

"Russel",

"Gasly",

"Leclerc",

"Ocon",

"Hulkenberg",

"Bottas",

"Hamilton",

"Albon",

"Tsunoda",

"Zhou",

"Stroll",

"De Vries",

"Magnussen",

"Norris",

"Piastri",

"Sargeant"

]

}

}

Et avec tout ça. L'OCR peut démarrer dans de bonnes conditions

OCR

Maintenant qu'on a des images qui arrivent automatiquement et que l'on sait où se trouvent les informations sur ces dites images, je vais parler de la seconde partie du projet qui parle du processus de reconnaissance de data sur une image du feed DATA de la F1TV.

C'est je pense la partie qui a demandé le plus tests et de refactor.

Toute la partie OCR a été développée dans un projet à part avant d'être intégrée dans le projet final.

Il faut savoir que la reconnaissance est différente selon ce que l'on cherche. Je vais donc décomposer cette partie du document en sous rubriques selon les données recherchées.

Mais avant ça, je dois expliquer certains concepts qui seront importants.

Fonctionnement général

Voici un screenshot de la page DATA de la F1TV que le programme va recevoir :

Si on regarde de loin, on peut se dire que la structure est plutôt simple, mais c'est loin d'être le cas. On peut y voir au moins quatre zones contenant de l'information dans un format différent.

Dans l'exemple ci-dessus, on peut voir trois zones, mais on aurait également pu comprendre la zone de position des pilotes autour du circuit pour faire 4.

Ces quatre zones sont très différentes et contiennent d'autres informations. Pour ce travail de diplôme, je ne m'occupe que de la zone principale. Mais je pense que le titre et les infos de circuit ne prendrait pas tant de temps que ça à implémenter.

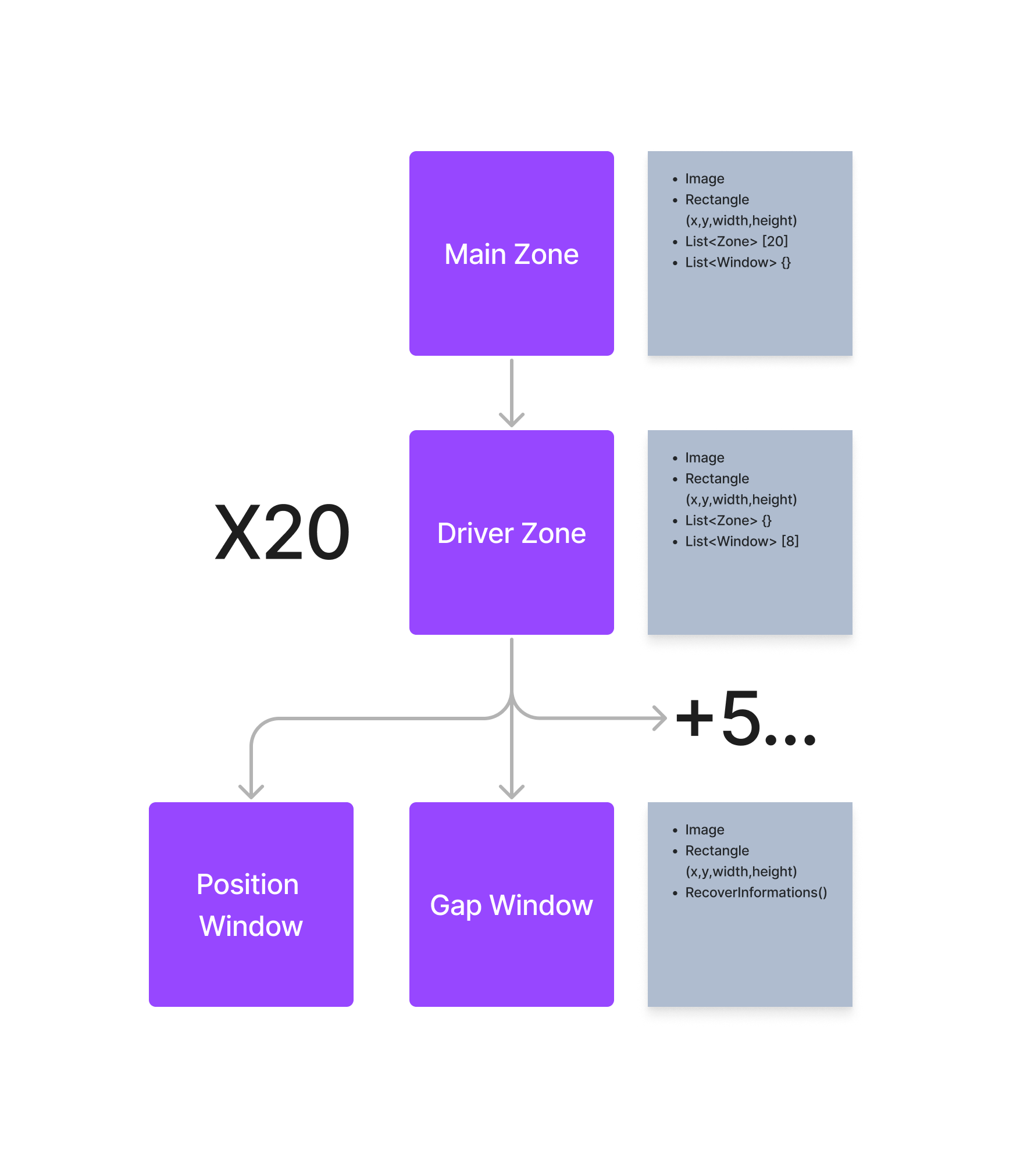

J'ai utilisé le mot "Zone" plus haut et ça n'est pas juste un mot utilisé au hasard. C'est le nom de l'objet que j'utilise pour les représenter dans mon programme. Mais comme c'est important de bien comprendre ce concept avant de continuer, je vais vous l'expliquer.

ZONE :

L'objet "Zone" parent est un objet qui est une zone d'image. Je m'explique, le but d'une zone est d'être un morceau d'une image plus grande.

Le but d'une Zone est de contenir une liste de plus petites Zones ou bien une liste de "Window" (j'explique ce que c'est juste après). Elle contient la portion d'image qui la concerne et ses propres dimensions.